In diesem Beitrag diskutieren wir die Frage, ob es eine KI-Blase gibt und, falls ja, ob diese bald zu platzen droht. Dazu stellen wir die aktuelle Situation aus zwei völlig verschiedenen Perspektiven dar:

- Die kritische Sichtweise, die zirkuläre Investitionen, fehlende Gewinne und mögliche Ressourcenengpässe in den Vordergrund stellt

- Die optimistische Sichtweise, die vor allem die Chancen und mögliche Effizienzsteigerungen betont

Pro: Ja, es gibt eine KI-Blase, die zu platzen droht

Für das Bestehen einer KI-Blase sprechen verschiedene Argumente, die in der öffentlichen Diskussion immer wieder angeführt werden:

- Hohen KI-Investitionen stehen nur moderate Steigerungen der Wertschöpfung und der Effizienz gegenüber.

- Es gibt physische und technologische Engpässe, insbesondere bei Hardware und Energie.

- Zirkuläre Investments blähen die Bilanzen der Akteure künstlich auf.

Sehen wir uns das im Detail an.

Die Weltwirtschaft durchläuft gegenwärtig eine der intensivsten Kapitalallokationsphasen der modernen Industriegeschichte. Getrieben durch das Versprechen der Generativen Künstlichen Intelligenz (GenAI), haben die größten Technologiekonzerne der Welt – oft als Hyperscaler zusammengefasst – einen Investitionszyklus initiiert, der in seiner Geschwindigkeit und seinem absoluten Volumen historische Vergleiche, einschließlich des Dotcom-Booms und des Ausbaus der Telekommunikationsnetze, in den Schatten stellt.

Die kumulierten Investitionen in Rechenzentren, Halbleitertechnologie und Energieinfrastruktur werden bis zum Ende des Jahrzehnts voraussichtlich die Marke von einer Billion US-Dollar überschreiten. Diese Kapitalflüsse basieren auf der Annahme, dass KI eine Basistechnologie darstellt, die das globale Bruttoinlandsprodukt (BIP) signifikant anheben wird.

Während die Hardware- und Infrastrukturanbieter Rekordgewinne verzeichnen, deuten Indikatoren auf der Software- und Enterprise-Ebene auf eine zögerliche Adaption, unklare Return-on-Investment (ROI)-Profile und physikalische Grenzen bei der Skalierung hin.

Unter Berücksichtigung technischer Engpässe wie Energieknappheit, algorithmischer Sättigungseffekte („Diminishing Returns") und geopolitischer Verwerfungen stellt sich die Frage, ob die aktuelle Bewertung der KI-Ökonomie nachhaltig ist oder ob eine drastische Marktkorrektur bevorsteht.

Die Anatomie der Hyper-Investition: CapEx-Dynamiken und Infrastrukturaufbau

Die Eskalation der Kapitalbindung

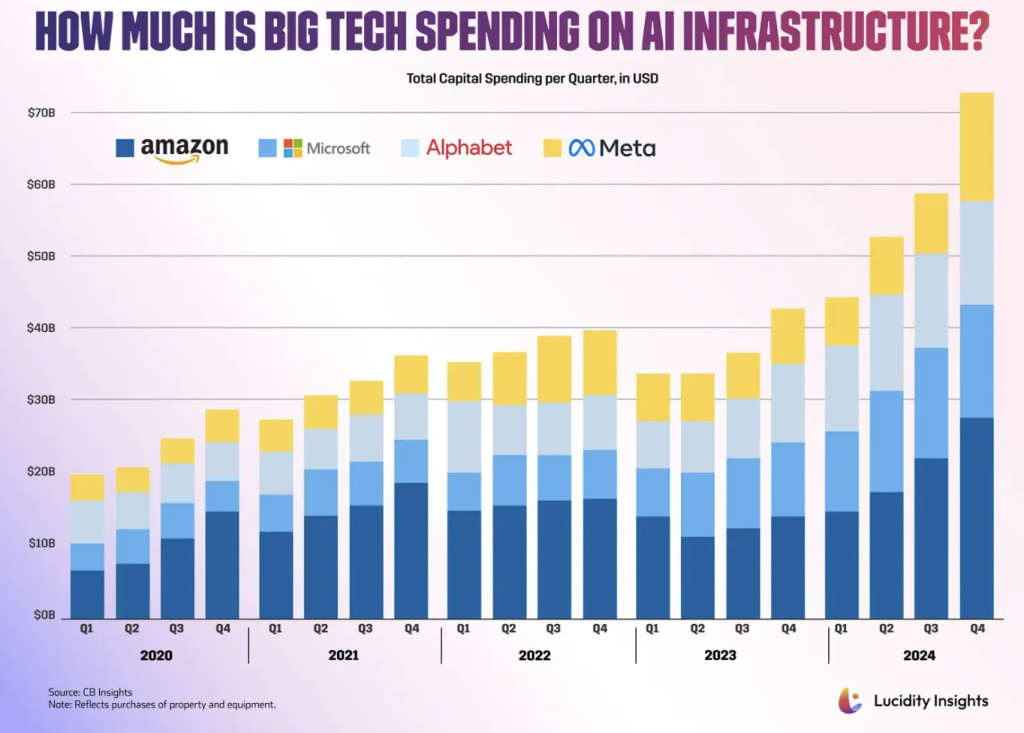

Das Jahr 2025 markiert einen Wendepunkt in der Unternehmensstrategie der „Big Tech"-Akteure. Die Investitionsbudgets von Amazon, Microsoft, Alphabet (Google) und Meta haben sich von einer nachfrageorientierten Planung entkoppelt und folgen nun einer antizipatorischen Logik: Infrastruktur wird präventiv aufgebaut, um im Rüstungswettlauf um Rechenkapazität nicht ins Hintertreffen zu geraten.

Analysen wie die von Lucidity Insights zeigen, dass allein diese vier Unternehmen im Jahr 2025 zusammen über 300 Milliarden US-Dollar in Investitionsausgaben (CapEx) lenken werden.

Quelle: https://lucidityinsights.com/infobytes/big-tech-ai-infrastructure-investment-2025

Diese Summen fließen primär in den Bau spezialisierter KI-Rechenzentren und die Beschaffung von Hochleistungsprozessoren. UBS prognostiziert, dass die globalen aggregierten KI-Investitionen von 423 Milliarden US-Dollar im Jahr 2025 auf 1,3 Billionen US-Dollar im Jahr 2030 ansteigen werden, was einer jährlichen Wachstumsrate (CAGR) von 25 % entspricht.

Diese Investitionstätigkeit übersteigt in ihrer Dimension staatliche Ausgabenprogramme. So haben die Technologiegiganten im Jahr 2025 bereits mehr Kapital für KI-Infrastruktur aufgewendet als die US-Regierung für Bildung, Arbeit und soziale Dienste zusammen. Diese Relationen verdeutlichen, dass es sich hierbei nicht um eine bloße sektorale Entwicklung handelt, sondern um eine makroökonomische Wette auf die Transformation der gesamten globalen Wertschöpfungskette.

| Unternehmen | CapEx-Prognose 2025 (Mrd. USD) | Strategischer Fokus & Implikationen |

| Amazon (AWS) | ca. 125 | Massive Expansion der Energieversorgung und Rechenzentren; Fokus auf eigene Chip-Architekturen zur Reduktion der Abhängigkeit von NVIDIA. |

| Alphabet (Google) | 91 – 93 | Integration von Gemini in Search und Workspace; Bau von TPUs (Tensor Processing Units) zur Effizienzsteigerung; Risiko der Verzögerung von Klimazielen durch Energiebedarf. |

| Microsoft | ca. 80 – 90 | Verdopplung der Rechenzentrumskapazität; Unterstützung der OpenAI-Modellentwicklung; Beseitigung von Engpässen bei der Energieversorgung |

| Meta | 60 – 72 | Fokus auf Open-Source-Modelle (Llama) und Integration in Consumer-Produkte; Aufbau massiver GPU-Cluster für Training und Inferenz. |

Tabelle 1: Prognostizierte CapEx-Entwicklung und strategischer Fokus der Hyperscaler (2025)

Die Divergenz zwischen Cloud-Wachstum und Infrastrukturkosten

Ein kritischer Indikator für die Gesundheit dieser Investitionen ist das Verhältnis zwischen dem Wachstum der Cloud-Umsätze und den steigenden Abschreibungen. Während Microsofts Azure-Sparte ein Wachstum von über 30 Prozent verzeichnet, vor allem getrieben durch KI-Dienste, zeigt Google Cloud Anzeichen einer Verlangsamung, was Investoren verunsichert. Das deutet darauf hin, dass die Nachfrage nach KI-Rechenleistung zwar vorhanden ist, aber möglicherweise nicht gleichmäßig über alle Anbieter verteilt ist oder durch physische Engpässe bei der Bereitstellung gedämpft wird.

Ein weiteres Risiko besteht in der Art der Hardware-Investitionen. Im Gegensatz zu traditionellen Servern, die über fünf bis sieben Jahre abgeschrieben werden, haben KI-Beschleuniger wie Nvidias H100/Blackwell-Chips einen wesentlich kürzeren technologischen Lebenszyklus. S&P Global Ratings schätzt, dass die Chips pro Jahr drei bis fünf Milliarden US-Dollar an Wert verlieren. Das erzeugt einen enormen Druck, diese Assets sofort nach Inbetriebnahme voll auszulasten (Monetarisierung). Stehen diese Chips aufgrund von Strommangel oder fehlender Software-Nachfrage still, vernichten sie Kapital in einer Geschwindigkeit, die traditionelle Geschäftsmodelle sprengt.

Das ROI-Dilemma: die Kluft zwischen Investition und monetarisierbarer Wertschöpfung

Die 600-Milliarden-Dollar-Lücke und die Umsatzrealität

David Cahn von Sequoia Capital prägte den Begriff der „600-Milliarden-Dollar-Frage" (inzwischen aufgrund gestiegener Prognosen eher eine „Billionen-Dollar-Frage"). Seine Analyse besagt, dass die KI-Branche Einnahmen generieren müsste, die ein Vielfaches der Infrastrukturkosten betragen, um eine nachhaltige Marge zu erzielen. Aktuell klafft jedoch eine massive Lücke zwischen den Ausgaben für die Infrastruktur und den Einnahmen auf der Anwendungsebene.

Während die Verkäufer der Infrastruktur-Ausstattung wie NVIDIA, TSMC und Anlagenbauer in einem Goldrausch leben, kämpfen die Anwender der Technik (SaaS-Unternehmen, Enterprise-Nutzer) mit der Profitabilität.

Kamer Daron Acemoğlu vom MIT erwartet, dass die Steigerungen bei Produktivität und BIP in den USA deutlich geringer ausfallen dürften, als dies von vielen erwartet wird. Statt einer Zunahme der Produktivität um neun Prozent und einer Steigerung des BIP von 6,5 Prozent rechnet er nur mit Zuwächsen von 0,5 bzw. einem Prozent innerhalb der nächsten zehn Jahre.

Um die aktuellen Investitionen zu rechtfertigen, müssten KI-Anwendungen Probleme lösen, die komplexer und wertstiftender sind als die bloße Textgenerierung oder Code-Vervollständigung.

Das Scheitern der Piloten und die „GenAI Divide"

Ein Bericht des MIT (State of AI in Business 2025) liefert ernüchternde Daten zur Adaption in der Realwirtschaft: Bis zu 95 % der generativen KI-Pilotprojekte in Unternehmen scheitern daran, in den produktiven Wirkbetrieb überführt zu werden oder skalierbaren Mehrwert zu liefern.

Die Gründe für dieses Scheitern sind vielfältig und strukturell bedingt:

- Mangelnde Datenqualität: Unternehmen unterschätzen den Aufwand für die Datenaufbereitung („Data Readiness"). Ohne saubere, unstrukturierte Daten liefern Modelle unzuverlässige Ergebnisse (Halluzinationen).

- Governance und Compliance: Die rechtlichen und sicherheitstechnischen Hürden für den Einsatz autonomer Agenten in kritischen Geschäftsprozessen sind oft unüberwindbar.

- Fehlender Business Case: Oft werden KI-Lösungen auf Probleme angewendet, die keine KI erfordern, oder die Effizienzgewinne rechtfertigen nicht die hohen Inferenzkosten.

McKinsey bestätigt diese Beobachtung und stellt fest, dass nur eine kleine Gruppe von „High Performers" tatsächlich signifikante Werte aus KI generiere, während die breite Masse, die sogenannte „GenAI Divide", noch in der Experimentierphase feststecke.

Das hat direkte Auswirkungen auf die Zahlungsbereitschaft: Wenn Unternehmen keinen ROI sehen, werden sie ihre Abonnements für teure KI-Tools wie Microsoft Copilot oder Salesforce Agentforce nicht verlängern oder nicht in die breite Fläche ausrollen.

Preismacht und Churn-Risiken bei Software-Anbietern

Die Schwierigkeiten bei der Monetarisierung zeigen sich exemplarisch bei Salesforce und Microsoft. Salesforce hat Preiserhöhungen von sechs bis neun Prozent durchgesetzt, um die KI-Funktionalitäten zu monetarisieren, und argumentiert mit der Kunenbindung der Produkte. Analysen zeigen jedoch, dass ein Großteil des Umsatzwachstums rein preisgetrieben ist und nicht auf Volumenwachstum basiert. Das könnte ein Anzeichen für eine Sättigung sein.

Die Einführung von „Agentforce" soll dem entgegenwirken. Der Beweis, dass Kunden bereit sind, für verbrauchsbasierte KI-Agenten zu zahlen, steht allerdings noch aus.

Bei Microsoft Copilot zeigt sich ein gemischtes Bild. Zwar berichten einige Unternehmen von Produktivitätsgewinnen, doch externe Daten deuten auf sinkende monatliche Web-Besuche und Downloads im Jahr 2025 hin. Die Einführung von Rabatten für Partner könnte als Indikator gewertet werden, dass die organische Nachfrage preissensitiver ist als erwartet. Eine verstärkte Kundenabwanderung bei diesen Tools würde die Rückfinanzierung der gigantischen Azure-Investitionen gefährden.

| Indikator | Beobachtung | Implikation |

| Start-up Burn Rates | Viele KI-Startups haben Burn Multiples von mehr als 2.5 (Ausgaben vs. Umsatz); Inferenzkosten fressen Margen. | Konsolidierungswelle und Pleiten bei Startups ohne klares Geschäftsmodell („Wrapper"). |

| Jasper AI | Umsatzrückgang von 120 Millionen US-Dollar (2023) auf 35 Millionen US-Dollar (2024); Bewertungseinbruch; Entlassungen. | Warnsignal für „Wrapper"-Geschäftsmodelle, die leicht durch Hyperscaler-Funktionen ersetzt werden können. |

| Stability AI | Finanzielle Schieflage; hohe Schulden bei Cloud-Providern; Umsatz weniger als 5 Millionen US-Dollar bei mehr als 30 Millionen US-Dollar Verlust pro Quartal. | Zeigt, dass selbst populäre Basismodelle (Stable Diffusion) schwer zu monetarisieren sind. |

Tabelle 2: Indikatoren für Marktstress im KI-Software-Sektor

Physische Wachstumsgrenzen: Der Energie- und Ressourcen-Engpass

Ein oft übersehener, aber entscheidender Faktor für die Wirtschaftlichkeit der KI-Investitionen sind die physikalischen Grenzen der Skalierung. Die digitale Welt ist untrennbar an die physische Welt der Energieerzeugung und Wärmeabfuhr gebunden.

Die Energiekrise der Rechenzentren

Der Energiebedarf von KI-Anwendungen ist exorbitant. Eine Anfrage an ein LLM wie ChatGPT verbraucht schätzungsweise zehnmal so viel Energie wie eine Google-Suche. Prognosen deuten darauf hin, dass der Strombedarf von Rechenzentren in den USA bis 2030 auf über 600 Terawattstunden (TWh) steigen könnte, was einer Verdreifachung entspräche.

Zwischen 2025 und 2028 wird in den USA eine Lücke von bis zu 44 Gigawatt (GW) an Erzeugungskapazität erwartet – das Äquivalent von 44 neuen Atomreaktoren. Diese Knappheit führt zu drastischen Konsequenzen:

- Stranded Assets: Microsoft-CEO Satya Nadella warnte explizit davor, dass Chips im Wert von Milliarden ungenutzt im Lager liegen könnten, weil keine betriebsbereiten Rechenzentren verfügbar sind. Dies erhöht das Risiko von Abschreibungen massiv.

- Preisanstieg: Der Wettbewerb um Stromverträge (PPAs) treibt die Preise, was die Betriebskosten (Opex) der KI-Modelle erhöht und die Margen drückt.

- Netzstabilität: Die Belastung alternder Stromnetze erhöht das Risiko von Ausfällen, was die Zuverlässigkeit der Cloud-Dienste gefährden könnte.

Geografische Moratorien und Wasserknappheit

Die physische Expansion stößt auch auf regulatorischen Widerstand. Irland, das als europäischer Hub für Rechenzentren gilt, verbraucht bereits über 20 Prozent seines nationalen Stroms für diese Anlagen. Der Stromverbrauch der Rechenzentren wird bald den der Einwohner übersteigen.

Der Netzbetreiber EirGrid warnt, dass dieser Anteil bis 2030 auf 30 Prozent steigen könnte. Dies hat zu einem De-Facto-Moratorium für neue Projekte im Großraum Dublin geführt, was Tech-Giganten wie Amazon und Microsoft zwingt, ihre Pläne zu überdenken. Ähnliche Restriktionen gelten in Singapur.

Zusätzlich verschärft der Wasserverbrauch zur Kühlung die Situation. Bis 2030 könnte der KI-Boom jährlich bis zu 1,1 Milliarden Kubikmeter Wasser verbrauchen, was Konflikte in wasserarmen Regionen provoziert und strengere Umweltauflagen nach sich zieht. Diese Faktoren wirken als Bremsklotz für die theoretisch prognostizierten Wachstumskurven und erhöhen die Kapitalkosten für neue Projekte signifikant.

Das Risiko der Zirkulären Finanzierung („Round Tripping")

Ein besonders alarmierendes Strukturmerkmal der aktuellen KI-Ökonomie ist die Entstehung einer zirkulären Umsatzmechanik. Analysten und investigative Berichte weisen darauf hin, dass ein signifikanter Teil der ausgewiesenen KI-Umsätze der Hyperscaler nicht aus organischer Nachfrage der Endkunden stammt, sondern aus Investitionen in eigene Beteiligungen resultiert.

Der Mechanismus der inflationären Umsätze

Das Muster ist wie folgt: Ein Hyperscaler (z.B. Microsoft oder Amazon) investiert Milliarden Dollar in ein KI-Startup (z.B. OpenAI, Anthropic oder CoreWeave). Dieses Investment ist oft an die Bedingung geknüpft, dass das Startup das Kapital nutzt, um Cloud-Dienstleistungen beim Investor einzukaufen.

Beispiel OpenAI / Microsoft

Berichte legen nahe, dass OpenAI im Jahr 2024 und in den ersten Quartalen 2025 Milliardenbeträge für Inferenzkosten auf Azure ausgegeben hat. Ein großer Teil der Microsoft-Investitionen fließt also direkt als „Umsatz" an Microsoft zurück. Kritiker wie Ed Zitron argumentieren, dass dies die Bücher beider Parteien künstlich aufblähe: Microsoft weist Cloud-Wachstum aus, und OpenAI zeigt massive operative Aktivität, finanziert durch Eigenkapital statt durch organischen Cashflow.

Implikation: Sollte der Zustrom an neuem Risikokapital versiegen, bricht dieser Kreislauf zusammen. Startups könnten ihre Cloud-Rechnungen nicht mehr bezahlen, was zu Umsatzwarnungen bei den Cloud-Providern führen würde.

Beispiel CoreWeave und das Nvidia-Ökosystem

Ein ähnliches Phänomen beobachtet man bei Nvidia und CoreWeave. Nvidia investiert in CoreWeave, einen spezialisierten GPU-Cloud-Anbieter. CoreWeave nutzt das Kapital (und Kredite, die mit Nvidia-Chips besichert sind), um weitere Nvidia-Chips zu kaufen. Das stützt Nvidias Umsatz und Auftragsbestand. Kritiker sehen hier Parallelen zu den „Vendor Financing"-Modellen der Dotcom-Ära, die beim Platzen der Blase zu massiven Ausfällen führten. Wenn CoreWeave aufgrund von Lieferkettenproblemen oder nachlassender Nachfrage in Schwierigkeiten gerät, könnte dies eine Kettenreaktion auslösen.

Technologische Sättigung: Die Grenzen der Skalierung

Die ökonomische Wette der Hyperscaler basiert auf den sogenannten „Scaling Laws" – der Annahme, dass mehr Rechenleistung und mehr Daten linear zu intelligenteren Modellen führen. Neuere Forschungen stellen diese Annahme jedoch in Frage und deuten auf abnehmende Erträge hin.

Diminishing Returns und Datenerschöpfung

Studien zeigen, dass die Skalierung von Modellgrößen (Parameteranzahl) und Trainingsdaten nicht mehr im gleichen Maße zu Qualitätsverbesserungen führt wie bei früheren Generationen (z.B. der Sprung von GPT-3 zu GPT-4). Forscher stellen fest, dass die Überzeugungskraft und logische Kohärenz von Modellen bei weiterer Skalierung nur noch marginal zunimmt („sharply diminishing returns").

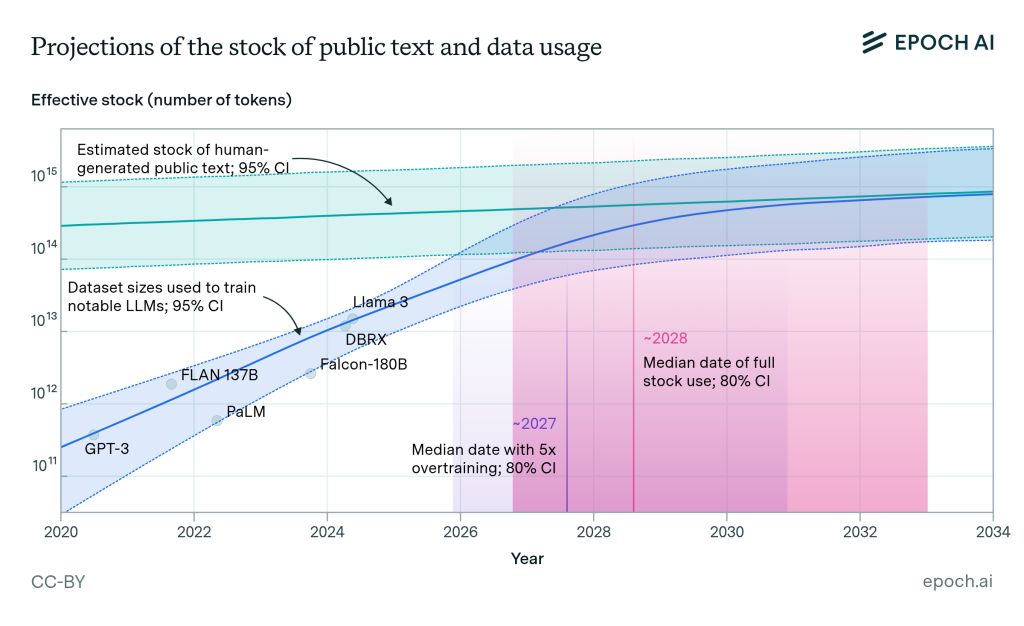

Ein noch größeres Problem ist der Mangel an neuem Trainingsmaterial („Data Exhaustion"). Epoch AI prognostiziert, dass der Vorrat an hochwertigem, von Menschen generiertem Text zwischen 2026 und 2032 vollständig aufgebraucht sein wird. Die Industrie versucht, dies durch synthetische Daten (von KI generierte Daten) zu kompensieren.

Quelle: https://epoch.ai/blog/will-we-run-out-of-data-limits-of-llm-scaling-based-on-human-generated-data

Model Collapse

Das Training mit synthetischen Daten birgt das Risiko des „Model Collapse". Forschungen zeigen, dass Modelle, die rekursiv mit ihren eigenen Outputs trainiert werden, eine degenerative Entwicklung durchlaufen: Die Varianz der Antworten nimmt ab, Randphänomene („Tails of distribution") verschwinden, und die Modelle verlieren den Bezug zur Realität. Wenn die KI mehr und mehr auf eigenen Daten aufbaut, könnte die Qualität der Modelle stagnieren oder sinken, was massive Investitionen in neue Hardware-Generationen (wie Llama 4 Cluster) ökonomisch fragwürdig macht.

Geopolitische Dynamiken: Der Faktor China

Ein globaler Vergleich der KI-Ökonomie offenbart eine signifikante Diskrepanz in der Kapitaleffizienz zwischen den USA und China.

Effizienz durch Zwang

Während US-Unternehmen versuchen, Probleme durch schiere Masse an Hardware („Brute Force") zu lösen, zwingen die US-Exportbeschränkungen für High-End-Chips chinesische Unternehmen zu extremer Effizienz. Analysten von Jefferies weisen darauf hin, dass chinesische Modelle wie DeepSeek oder MiniMax inzwischen ca. 90 Prozent der Leistung von US-Spitzenmodellen erreichen, jedoch nur einen Bruchteil der Investitionskosten (CapEx) erfordern.

Chinesische Hyperscaler wie Alibaba, Tencent oder Baidu investieren kumuliert deutlich weniger als ihre US-Pendants, erreichen aber durch Architektur-Innovationen wie Mixture-of-Experts-Modelle wettbewerbsfähige Ergebnisse.

Dies stellt ein langfristiges Risiko für das US-Modell dar: Wenn chinesische Anbieter vergleichbare Intelligenz zu drastisch niedrigeren Inferenzkosten anbieten können, untergräbt dies die Preissetzungsmacht der US-Hyperscaler. Die massiven Hardware-Investitionen im Westen müssten über hohe Preise amortisiert werden, was im globalen Wettbewerb gegen effizientere chinesische Modelle schwierig werden könnte. Zudem besteht in China das Risiko von Überkapazitäten bei Rechenzentren, weil staatlich geförderte Bauprogramme das Angebot schneller wachsen ließen als die Nachfrage.

Makroökonomische Implikationen: Produktivität und BIP

Die Rechtfertigung für die Billionen-Investitionen in KI liegt in der Erwartung eines massiven Produktivitätsschubs. Hier stehen sich allerdings zwei Lager gegenüber:

- Die Optimisten wie Goldman Sachs und IMF: Sie prognostizieren, dass KI das globale BIP um sieben Prozent (ca. 7 Billionen USD) steigern und das Produktivitätswachstum in den USA um 1,5 Prozentpunkte pro Jahr erhöhen könnte. Sie sehen KI als transformative Kraft, die neue Berufsfelder schafft und Arbeitskräftemangel kompensiert.

- Die Skeptiker wie Daron Acemoglu vom MIT: Acemoglu argumentiert, dass KI nur etwa fünf Prozent aller Aufgaben kosteneffizient automatisieren könne. Er prognostiziert lediglich einen Produktivitätszuwachs von 0,5 % und ein kumuliertes BIP-Wachstum von 0,9 % über das nächste Jahrzehnt. Seine These stützt sich darauf, dass viele Aufgaben zu komplex für die aktuellen Modelle seien („hard-to-learn tasks") und der wirtschaftliche Nutzen oft durch die Kosten der Implementierung aufgefressen werde.

Sollte das skeptische Szenario eintreten, wären die aktuellen Investitionen eine massive Fehlallokation von Kapital, die Ressourcen aus anderen Sektoren abzieht und die Renditeerwartungen der Investoren enttäuschen muss.

Szenario-Analyse: Das Platzen der Blase

Angesichts der beschriebenen Risiken – Diskrepanz zwischen CapEx und Umsatz, Energieengpässe, zirkuläre Finanzierung und technologische Sättigung – wächst die Wahrscheinlichkeit einer Marktkorrektur.

Systemisches Risiko und Marktkonzentration

Das Risiko einer Korrektur wird durch die extreme Konzentration im S&P 500 verschärft. Die „Magnificent 7″ (inkl. Nvidia, Microsoft, Apple) machen mittlerweile ca. 40 Prozent des Indexgewichts aus. Eine Korrektur bei Nvidia würde über Volatilitätsmechanismen und passive Indexfonds den gesamten Markt mitreißen.

Hedgefonds-Legenden wie Stanley Druckenmiller und Peter Thiel haben ihre Positionen in Nvidia bereits reduziert oder aufgelöst, was als Signal gewertet wird, dass das „Smart Money" den Höhepunkt des Hypes („Peak AI") für erreicht hält. Elliott Management bezeichnet Nvidia als in einer „Blase" befindlich und warnt, dass die Technologie für den Masseneinsatz noch nicht bereit ist.

Auslöser und Wahrscheinlichkeit

Ein mögliches Platzen der Blase könnte durch folgende Trigger ausgelöst werden:

- Enttäuschende Earnings: Wenn Microsoft oder Google zugeben müssen, dass die KI-Umsätze die Abschreibungen nicht decken.

- Hardware-Glut: Ein Überangebot an HBM-Speicher oder GPUs ab 2026/2027, wenn neue Fabriken online gehen, aber die Nachfrage stagniert.

- Credit Event: Ein Zusammenbruch eines großen KI-Startups (wie CoreWeave oder OpenAI), der die zirkulären Finanzierungsströme offenlegt.

Die Wahrscheinlichkeit einer „harten Landung" (Hard Landing) ist erheblich, weil die Bewertungen (Price-to-Sales Ratios) weit über den historischen Normen liegen und die Infrastruktur „auf Vorrat" gebaut wurde.

Contra: Warum es keine „KI-Blase" gibt

Die mediale Debatte um eine bevorstehende „KI-Blase" basiert auf fundamentalen Missverständnissen über die Wirtschaftlichkeit moderner KI-Infrastruktur. Nach eingehender Analyse der Finanzströme, Investitionszyklen und technologischen Entwicklungen zeigt sich: Wir stehen nicht vor einem Crash, sondern vor einer radikalen Machtverschiebung innerhalb der Wertschöpfungskette.

Die zentrale These: Die massiven CAPEX-Ausgaben von über 1,5 Billionen US-Dollar bis 2027 sind durch verlängerte Abschreibungszyklen (7+ Jahre) und proprietäre Chip-Architekturen ökonomisch tragfähig. Das eigentliche Risiko liegt nicht im Kollaps der Nachfrage, sondern in der Erosion der Nvidia-Monopolrente durch die technologische Emanzipation der Hyperscaler.

Die finanzielle Ausgangslage

Die drei großen Cloud-Anbieter zeigen Ende 2025 eine bemerkenswerte finanzielle Robustheit:

| Unternehmen | Cloud Umsatz 2025 | Operativer Gewinn | Marge | CAPEX 2025 |

| Amazon (AWS) | ~132 Mrd. $ | ~45 Mrd. $ | ~34% | ~125 Mrd. $ |

| Microsoft (Intelligent Cloud) | ~123 Mrd. $ | ~53 Mrd. $ | ~43% | ~95 Mrd. $ |

| Google Cloud | ~61 Mrd. $ | ~14 Mrd. $ | ~23% | ~92 Mrd. $ |

Auf den ersten Blick erscheinen die CAPEX-Ausgaben bedrohlich – sie übersteigen teilweise die operativen Gewinne. Doch diese Betrachtung ignoriert zwei fundamentale Verschiebungen in der Ökonomie der Cloud-Infrastruktur.

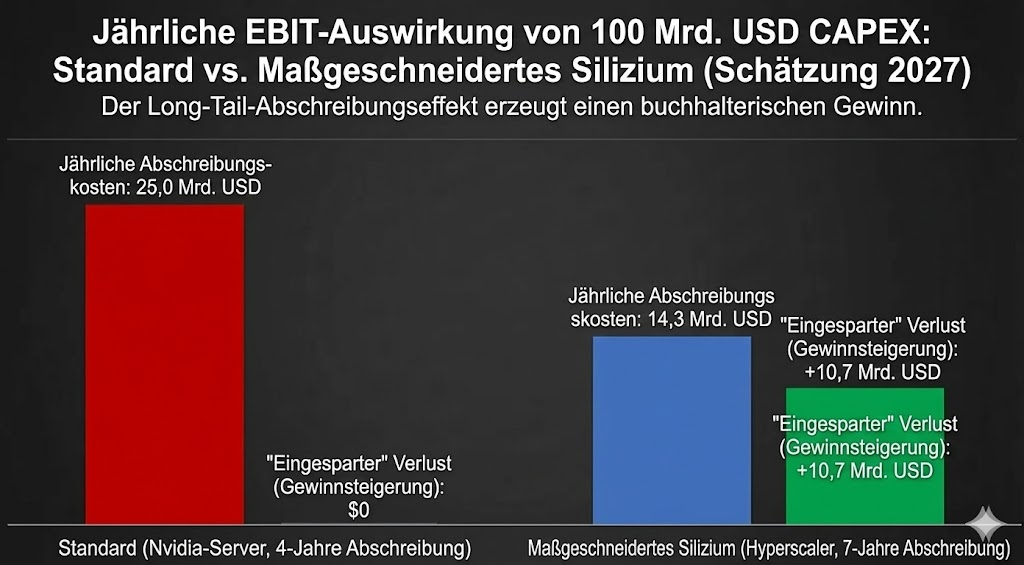

Der „Long-Tail"-Abschreibungseffekt

Kritiker kalkulieren traditionell mit 3-4 Jahren Nutzungsdauer für Server-Hardware – dem typischen Nvidia-GPU-Zyklus. Diese Annahme ist für die Hyperscaler jedoch längst überholt.

Die neue Realität:

Durch die Entwicklung eigener Chip-Architekturen (Google TPU, AWS Trainium/Inferentia, Microsoft Maia) kontrollieren die Unternehmen den gesamten Hardware- und Software-Stack. Dies ermöglicht eine deutlich längere effiziente Nutzung:

- Alte Hardware für Inferenz: 3-5 Jahre alte Chips werden für das Ausführen fertiger Modelle (Inferenz) eingesetzt

- Neue Hardware für Training: Nur die neueste Generation wird für das ressourcenintensive Training verwendet

- Abschreibungsdauer: Realistisch 7+ Jahre statt 4 Jahre

Die finanzielle Auswirkung:

Bei 100 Mrd. US-Dollar CAPEX pro Jahr:

- Standard-Szenario (4 Jahre): 25 Mrd. US-Dollar jährliche Belastung

- Long-Tail-Szenario (7 Jahre): 14,3 Mrd. US-Dollar jährliche Belastung

Ergebnis: Durch verlängerte Abschreibungszyklen „erschaffen" die Hyperscaler über 10 Mrd. US-Dollar zusätzlichen operativen Gewinn pro Unternehmen und Jahr – ohne dass sich an der realen Wirtschaftlichkeit etwas ändert.

Abbildung 1: Die „magische" Buchhaltung der Cloud-Giganten: Durch die Verlängerung der Abschreibungsdauer auf 7 Jahre für eigene Chips wandeln sie Milliarden an Kosten in operativen Gewinn um.

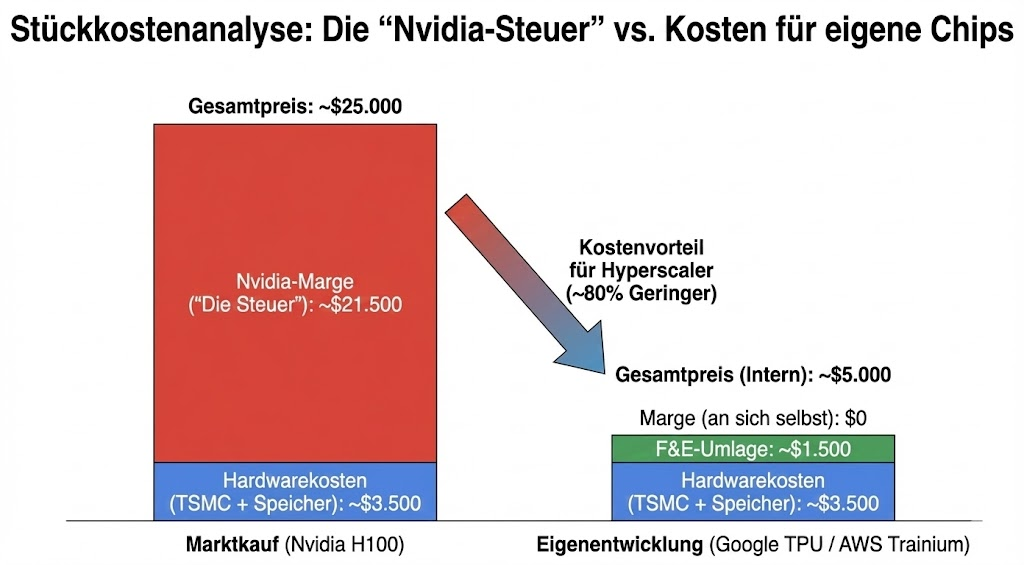

Custom Silicon: die Befreiung von der „Nvidia Steuer"

Die Einheitsökonomie hat sich fundamental gedreht. Nachfolgend Kostenvergleich pro Compute-Einheit zwischen einer Nvidia GPU und eigenen Chips:

- Nvidia GPU (Marktpreis): 100% (Referenz)

- Eigener Chip (TSMC-Fertigung + R&D): 40-50%

Diese Ersparnis von 50-60% ermöglicht es den Hyperscalern:

- Stabile Endkundenpreise zu halten

- Margen zu expandieren

- Profitabel zu bleiben, selbst bei nicht vollständiger Auslastung

Strategische Implikation: Diese Kosteneinsparungen wirken einer „Blase" in der Gewinn- und Verlustrechnung entgegen, weil die Kosten strukturell und nachhaltig gesenkt werden.

Abbildung 2: Der 80%-Vorteil: Warum für Google keine KI-Blase existiert. Durch den Verzicht auf die „Nvidia-Steuer" sind ihre internen Kosten für Rechenleistung dramatisch niedriger als der Marktpreis.

Meta: Der unsichtbare Gewinner

Meta nimmt eine Sonderstellung ein, weil das Unternehmen keine Cloud-Infrastruktur verkauft, sondern KI nutzt, um sein Kerngeschäft zu verteidigen und auszubauen.

Die unsichtbare Amortisation

CAPEX 2025: ca. 70 Mrd. US-Dollar

Anders als bei klassischen Cloud-Anbietern muss Meta keinen direkten „KI-Umsatz" ausweisen. Die Refinanzierung erfolgt indirekt:

Mechanismen:

- Verbesserte Ad-Performance: Eine Steigerung der Click-Through-Rate um nur 10% durch besseres Targeting generiert 15-20 Mrd. US-Dollar Mehrumsatz

- Längere Verweildauer: KI-optimierte Reels und Feed-Algorithmen erhöhen die Nutzungszeit

- Kosteneinsparungen: Automatisierte Content-Moderation und Optimierung

Die Rechnung: Bei einem Werbe-Umsatz von über 150 Mrd. US-Dollar jährlich amortisiert sich die KI-Infrastruktur bereits bei marginalen Effizienzsteigerungen.

MTIA: Metas stiller Nvidia-Exit

Während Meta medienwirksam große Mengen H100-GPUs kauft, läuft das eigentliche Geschäft zunehmend auf eigenen Chips. Hier ist insbesondere der MTIA (Meta Training and Inference Accelerator) zu nennen. Während des Training für Llama-Modelle auf Nvidia GPUs stattfindet, nutzt Meta für Inferenz und für Milliarden täglicher Nutzer-Interaktionen eigene Chips.

Strategischer Effekt: Meta schützt sich vor Margendruck und nutzt KI als „Burggraben" gegen Wettbewerber – eine defensive, aber hochprofitable Strategie.

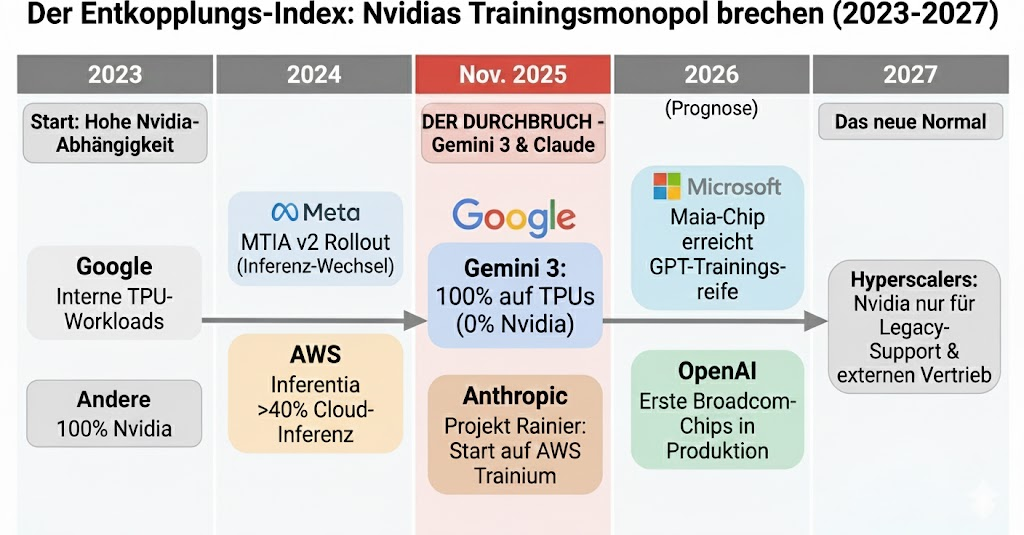

Das „Great Decoupling": Das Ende der CUDA-Hegemonie

Der November 2025 markiert einen historischen Wendepunkt: Die technologische Abhängigkeit von Nvidia für das Training von Spitzenmodellen ist gefallen. Damit entfällt auch die Abhängigkeit von CUDA – Nvidias Plattform und Programmiermodell für parallele Berechnungen.

Die Präzedenzfälle

Google Gemini 3 (November 2025):

Die technische Dokumentation von Google Deepmind bestätigt: Training zu 100% auf TPUs. Kein einziger Nvidia-Chip war beteiligt.

Anthropic Claude:

Durch den strategischen AWS-Deal läuft Claude primär auf Amazon Trainium-Chips. Die Investitionsrunde 2024 enthielt eine explizite Klausel zur AWS-Nutzung.

OpenAI:

Trotz enger Microsoft-Partnerschaft entwickelt OpenAI mit Broadcom eigene Chips und nutzt über Oracle Cloud Zugang zu diversifizierten Ressourcen, einschließlich Google TPUs.

Der Software-Bruch: PyTorch & Triton

Die These vom „unüberwindbaren CUDA-Burggraben" ist technisch überholt. Das zeigt sich alleine am Beispiel von Meta:

- PyTorch 2.0: Hardware-agnostisches Framework

- OpenAI Triton: Compiler für verschiedene Chip-Architekturen

- Resultat: Code-Portierung zwischen Nvidia, AMD, AWS und Google ist heute oft nur noch eine Frage der Kompilierung

Die strategische Bedeutung: Der Vendor Lock-in ist softwareseitig durchbrochen. Gleichzeitig sinken die Wechselkosten deutlich.

Implikationen für den Markt

Wenn die vier größten KI-Firmen der Welt (Google, Amazon, Meta, OpenAI) planen, langfristig ihre Abhängigkeit von Nvidia gegen Null zu fahren, verschiebt sich die Gewinnverteilung fundamental:

- Von: Nvidia als Monopolist mit 74% Bruttomarge

- Zu: Hyperscalern und Modellbauern mit vertikaler Integration

Abbildung 3: Der stille Putsch: Wie sich Google, Amazon und Co. Stück für Stück aus der Nvidia-Umklammerung gelöst haben – mit Gemini 3 als entscheidendem Wendepunkt.

Die LLM-Ebene: Vier Strategien, vier Schicksale

Google Gemini: Die vertikale Festung

Google hat die volle Kontrolle: Vom Chip (TPU) über das Rechenzentrum bis hin zum Modell. Hinzu kommt die Distribution über das Betriebssystem Android sowie über die verschiedenen Google Produkte, allen voran die Suche.

Der ökonomische Vorteil: Google hat die niedrigsten Grenzkosten pro Token im gesamten Markt

Damit kann Google auf dem Markt die Rolle als Preisstabilisator einnehmen und die KI-Preise senken, ohne die Profitabilität zu gefährden. Google zwingt damit andere, ihre Kostenstrukturen anzupassen.

OpenAI: Die Flucht nach vorn

Die Herausforderung für OpenAI ist, dass das Unternehmen die stärksten Abhängigkeiten von externen Anbietern hat, allen voran von Microsoft und Nvidia.

Allerdings vollzieht OpenAI derzeit eine strategische Wende:

- Broadcom-Deal: Eigene Chips bis 2026/27

- Oracle-Partnerschaft: Diversifikation weg von reiner Azure-Abhängigkeit

- Das Ziel: Hardware-Agnostiker werden

- Die Prognose: Gelingt der eigene Chip, wird OpenAI hochprofitabel. Scheitert der Übergang jedoch, droht die Margenfalle bei Skalierung auf GPT-5/6.

Anthropic Claude: Der Effizienz-Pragmatiker

Die aktuelle Strategie von Anthropic scheint im Aufbau einer engen Bindung an das Amazon-Ökosystem zu bestehen. Laut Berichten soll Amazon etwa vier Milliarden US-Dollar in Anthropic investiert haben und erhält dafür einen bevorzugten Zugriff auf die Technologie des Unternehmens.

Der Vorteil für Anthropic liegt vor allem in der strukturell günstigeren Kostenbasis durch die Nutzung von Amazon Trainium-Chips.

Das könnte dem Markt beweisen, dass man State-of-the-Art sein kann, ohne eine „Nvidia-Steuer" entrichten zu müssen.

xAI: Der Brute-Force-Außenseiter

xAI genießt eine Sonderstellung durch seine Dual-Use-Infrastruktur für Grok und Tesla FSD.

Mit Colossus errichtet xAI in Memphis ein Rechenzentrum mit mehr als 100.000 Nvidia H100-GPUs in Memphis – das bisher größte Nvidia-Cluster weltweit. In den nächsten 5 Jahren soll die Leistung auf 50 Millionen H-100-Äquivalente erweitert werden.

Ökonomie: Selbst bei einem möglichen Platzen der KI-Blase hat die Hardware einen Restwert im Robotaxi-Training. Musk ist der „Demand-Driver of last resort" für Nvidia, kann aber jederzeit auf eigene Chips (Dojo) umschwenken.

Oracle: die Schweiz der KI-Infrastruktur

Oracle wird oft übersehen, spielt aber eine Schlüsselrolle bei der Stabilisierung des Marktes.

Der „Interconnector"

OpenAI bewegt sich strategisch in einer neutralen Zone zwischen den Hyperscaler-Giganten und pflegt verschiedene Partnerschaften:

- Microsoft (Bing-Kapazitäten)

- Google (Cloud Interconnect)

- OpenAI (Overflow-Kapazitäten)

5.2 Warum Oracle gewinnt

Oracle hat gute Chancen, als großer Gewinner aus der aktuellen Entwicklung hervorzugehen. Das liegt in erster Linie an einer Differenzierung von Tier-2-Anbietern, also von Anbietern, die sich zwischen den Herstellern und den Endkunden positionieren. Das hat vor allem folgende Gründe:

- Bestehende Enterprise-Basis: Datenbank-Kunden wollen KI am Ort ihrer Daten

- Technische Überlegenheit: RDMA-Netzwerkarchitektur ist oft effizienter für große Cluster

- Unabhängigkeit: Sicherheitsnetz für Firmen, die nicht von einem einzigen Hyperscaler abhängig sein wollen

Oracles Marktfunktion: Das Unternehmen gleicht Engpässe aus und verhindert damit Preisexplosionen, welche die Wirtschaftlichkeit gefährden würden.

Die Verlierer: Tier-2-Anbieter und Nvidia

CoreWeave & Co.: die Commodity Trap

CoreWeave und ähnliche Anbieter verfolgten in den vergangenen Jahren dals Geschäftsmodell die Vermietung von GPUs. In Zeiten der Knappheit hat das auch sehr gut funktioniert.

Das Problem 2026/2027: Es gibt eine Abwanderung von Kunden an verschiedenen Stellen:

- Von Anthropic zu AWS

- Von OpenAI auf eigene Chips

- Google setzt auf eigene Chips (TPUs).

Die Folge ist ein Preisverfall: Prognostiziert wird ein Rückgang des Mietpreises für eine H100-Stunde von 4 US-Dollar auf 1,50 US-Dollar. Das erhöht den Schulden-Druck: Hardware ist oft kreditfinanziert, wobei GPUs als Sicherheit dienen.

Eine Beispiel-Rechnung:

- CAPEX: Ein Unternehmen hat Milliarden in Nvidia-Hardware investiert

- Abschreibung: 3-4 Jahre Standard

- Problem: Hardware verliert schneller an Wert, als sie abbezahlt werden kann

Fazit: Wenn eine Blase platzt, dann hier. Dies ist jedoch eine lokale Marktbereinigung, kein systemischer Kollaps.

Nvidia: Von Monopol zu „normalem" Chipanbieter

Für Nvidia lässt sich das Umsatz-Szenario 2027 wie folgt skizzieren:

| Kundensegment | 2025 | Wall Street 2027 | Realistisches Szenario 2027 |

| Hyperscaler (intern) | 72 Mrd. $ | 100 Mrd. $ | 15 Mrd. $ (-79%) |

| Hyperscaler (Cloud Resale) | 24 Mrd. $ | 40 Mrd. $ | 45 Mrd. $ (+88%) |

| Enterprise & Sovereign AI | 64 Mrd. $ | 120 Mrd. $ | 110 Mrd. $ (+72%) |

| GESAMT | 160 Mrd. $ | 260 Mrd. $ | 170 Mrd. $ (+6%) |

Kritischer als die Entwicklung des Umsatzes ist die Margenerosion:

| Kennzahl | 2025 | Wall Street 2027 | Realistisches Szenario 2027 |

| Bruttomarge | 74% | 72% | 55% |

| Operative Marge | 60% | 58% | 35% |

| Nettogewinn | 95 Mrd. $ | 150 Mrd. $ | 60 Mrd. $ |

Auswirkungen auf die Bewertung:

- Aktuell (Nov 2025): ca. 3,6 Bio. US-Dollar Marktkapitalisierung

- Bei Normalisierung: ca. 1,2 Bio. (KGV20 x auf 60 Mrd. Gewinn)

- Potenzieller Kursverlust: ca. 66%

Warum die Margen kollabieren:

- Hyperscaler nutzen interne Chips (kein Preisdruck mehr möglich)

- Wettbewerb mit AMD intensiviert sich im Enterprise-Segment

- Sovereign AI-Projekte verhandeln härter

Die aggregierten Investitionen 2025-2027

Der CAPEX-Tsunami

In den nächsten Jahren werden die Investitionen für KI bei den Hyperscalern und den Tier-2-Anbietern vermutlich weiter steigen und sich für den Zeitraum 2025 bis 2027 auf rund 1,5 Billionen US-Dollar summieren.

| Jahr | Hyperscaler (Big 4) | Tier 2 (CoreWeave, Oracle, etc.) | Gesamtinvestition |

| 2025 | ~380 Mrd. $ | ~40 Mrd. $ | ~420 Mrd. $ |

| 2026 | ~450 Mrd. $ | ~50 Mrd. $ | ~500 Mrd. $ |

| 2027 | ~500 Mrd. $ | ~60 Mrd. $ | ~560 Mrd. $ |

| SUMME | ~1,33 Billionen US-Dollar | ~150 Milliarden US-Dollar | ~1,48 Billionen US-Dollar |

Die OPEX-Falle

CAPEX ist nur die halbe Wahrheit. Der Betrieb der Infrastruktur verursacht massive laufende Kosten (OPEX):

Die treibenden Kostenfaktoren sind dabei der Stromverbrauch sowie das benötigte Personal.

- Stromverbrauch (oft 30-50% der Hardware-Kosten über die Lebensdauer)

- Kühlung (weitere 20-30%)

- Personal, Wartung, Netzwerk

Als Faustregel gilt: OPEX entspricht etwa 15-20 Prozent des kumulierten CAPEX pro Jahr.

Projektion: Ab 2027 müssen die Unternehmen jährlich 200-300 Mrd. US-Dollar für den reinen Betrieb aufwenden.

Warum die Rechnung trotzdem aufgeht

Trotz dieser enormen Investition und laufender Kosten ist für einen großen Teil der Akteure ein erfolgreicher Verlauf wahrscheinlich. Das zeigt eine Gegenüberstellung der prognostizierten Einnahmen und Ausgaben:

Einnahmen-Seite (2027 prognostiziert):

- AWS, Azure, Google Cloud: ca. 350 Mrd. US-Dollar Gesamtumsatz

- Operative Gewinne: ca. 120 Mrd. US-Dollar (bei 35% Marge)

- Meta (indirekte Monetisierung): ca. 25 Mrd. US-Dollar KI-attributierbar

Ausgaben-Seite:

- OPEX: 250 Mrd. US-Dollar

- Abschreibungen (7 Jahre): ca. 210 Mrd. US-Dollar

- Gesamt: ca. 460 Mrd. US-Dollar

Deckungsbeitrag: Die Rechnung ist knapp, aber positiv – und das bei konservativen Annahmen. Jedes Wachstum über die Prognose hinaus verbessert die Situation dramatisch.

Die Endkunden: Warum die Nachfrage stabil bleibt

Die ROI-Rechnung für Unternehmen

Ein durchschnittliches Unternehmen zahlt etwa 30 US-Dollar pro Mitarbeiter/Monat für KI-Tools (GitHub Copilot, ChatGPT Enterprise, etc.).

Break-Even-Analyse:

- Entwickler-Gehalt: 100.000 US-Dollar p.a.

- KI-Kosten: 360 US-Dollar p.a.

- Benötigte Effizienzsteigerung für ROI: 0,36%

Realität: Studien zeigen 20-50% Produktivitätssteigerung bei Coding-Aufgaben.

Schlussfolgerung: Selbst bei drastischen Übertreibungen in den Studien bleibt der Business Case robust. Die Blase platzt nur, wenn die Preise um Faktor 10+ steigen – was durch den Wettbewerb verhindert wird.

8.2 Neue Umsatzkanäle

In vielen Analysen zu einer möglichen KI-Blase werden völlig neue Geschäftsmodelle übersehen.

Beispiele:

- Autonomes Fahren: Tesla, Waymo (Milliarden-Märkte)

- Medikamentenentwicklung: KI verkürzt Entwicklungszyklen um Jahre

- Personalisierte Bildung: adaptive Lernplattformen

Diese „zweite Welle" der KI-Monetisierung steht erst am Anfang.

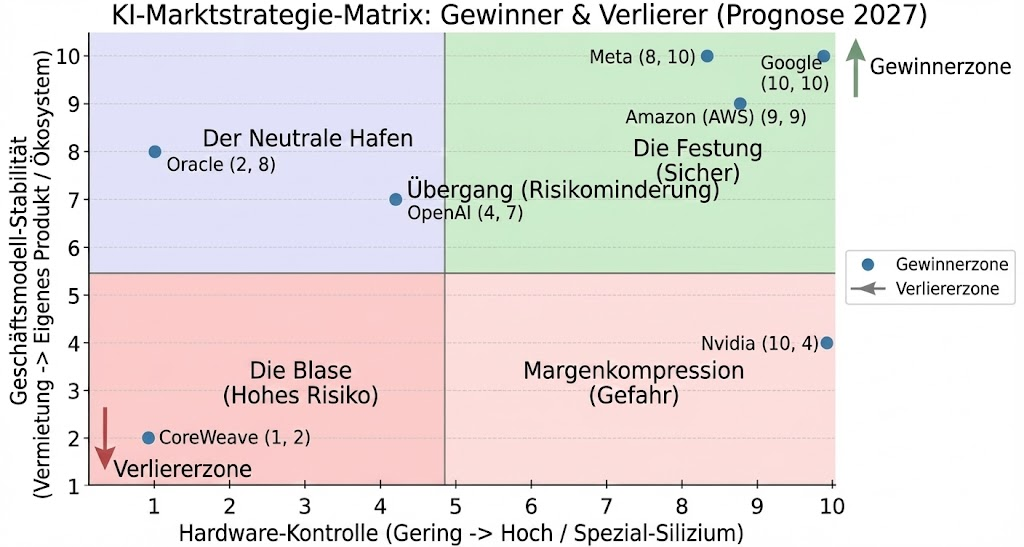

Gewinner-Verlierer-Matrix 2027

| Akteur | Status | Prognose | Begründung |

| GEWINNER | Margen-Expansion | Vollständige vertikale Integration; niedrigste Kosten | |

| Amazon AWS | GEWINNER | Marktanteil-Gewinn | Trainium überzeugt; Anthropic als Referenz |

| Microsoft | STABIL | Moderate Gewinne | Azure wächst, aber abhängig von OpenAI-Erfolg |

| Meta | GEWINNER | Unsichtbare Dominanz | KI als Burggraben; indirekte Monetisierung funktioniert |

| OpenAI | RISKANT | Alles oder Nichts | Muss Chip-Transition gelingen; sonst Margenkollaps |

| Anthropic | STABIL | Partnerschafts-Modell | Sicherer Hafen bei AWS |

| xAI | WILD CARD | Synergie-Spiel | Tesla-Querfinanzierung; kann Verluste aussitzen |

| Oracle | GEWINNER | Neutralitäts-Premium | Profitiert als Ausweich-Infrastruktur |

| Nvidia | VERLIERER | Normalisierung | Verlust der Monopol-Margen; bleibt groß, aber nicht dominant |

| Tier 2 Clouds | VERLIERER | Konsolidierung | Shakeout unvermeidlich; Pleiten wahrscheinlich |

Nachfolgend sind die prognostitierten Gewinner und Verlierer in einer strategischen Vier-Felder-Matrix zusammengestellt. Dabei wird auf der X-Achse nach der Stabilität des Geschäftsmodells und auf der Y-Achse nach der Hardware-Kontrolle unterschieden. Je stabiler das Geschäftsmodell und je größer die Kontrolle über die Hardware, desto günstiger ist das für die Aussichten der Unternehmen.

Abbildung 4: Das KI-Schlachtfeld 2027: Wer kontrolliert die Chips und das Ökosystem? Die Hyperscaler haben sich eine sichere Festung gebaut, während reine GPU-Vermieter (Tier 2) und Nvidia selbst unter Druck geraten.

Fazit: Die Blase härtet aus, sie platzt nicht

Die Analyse zeigt drei fundamentale Irrtümer der KI-Blasen-These:

- Falsche Kostenbasis: Kritiker rechnen mit Nvidia-Marktpreisen. Die Hyperscaler zahlen 50-60 Prozent weniger durch eigene Chips.

- Ignoranz gegenüber indirekter Monetisierung: Meta, Google (Suche) und andere verdienen an KI, ohne sie direkt zu verkaufen. Diese Cashflows erscheinen in keiner „KI-Umsatz"-Statistik.

- Unterschätzung der Abschreibungs-Flexibilität: Durch 7-Jahres-Zyklen werden „Verluste" zu „Investitionen" in der Bilanz umgedeutet – ohne dass sich an der Realität etwas ändert.

Wo die echten Risiken liegen

Die Blase ist lokal begrenzt, nicht systemisch. Es gibt einige Hochrisiko-Bereiche:

- Tier-2-Anbieter: CoreWeave, Lambda und ähnliche werden konsolidiert

- Nvidia-Aktie: Die aktuelle Überbewertung basiert auf der Annahme eines ewigen Monopols. Das endet.

- Spekulative KI-Startups: Ohne Produktivitäts-Nachweis ist keine Finanzierung mehr möglich.

Demgegenüber stehen einige sichere Bereiche:

- Hyperscaler-Infrastruktur: Sie sind durch eigene Chips und Cloud-Lock-in geschützt

- Produktive KI-Anwendungen: ROI ist nachweisbar

- Foundational Models: wenige große Player dominieren

Die Dotcom-Analogie – und warum sie nicht passt

Oft wird die Dotcom-Blase und hier Cisco als Warnung herangezogen: Cisco baute Glasfaser-Netze, die niemand brauchte. Der fundamentale Unterschied ist aber:

- Damals: Infrastruktur wurde ohne Nachfrage errichtet (spekulativ).

- Heute: Infrastruktur wird mit nachweisbarem ROI erstellt (produktiv).

Die Glasfaserkabel von 2000 wurden erst 10 Jahre später profitabel genutzt. KI-Infrastruktur zahlt sich dagegen bereits heute aus.

Um es noch einmal zu betonen: Nicht alle Bereiche werden es schaffen, in die Profitabilität zu kommen. Es gibt in bestimmten Feldern durchaus relevante Risiken. Zu ihnen gehören:

- Nvidia's Monopol-Bewertung (66 Prozent Kursrisiko)

- Spekulative GPU-Vermieter (CoreWeave-Modell)

- Übertriebene Wachstumsprognosen

Nicht betroffene Bereiche sind dagegen:

- Die Investitionen in Rechenzentren (wirtschaftlich sinnvoll)

- Die Cloud-Geschäfte der Hyperscaler (wachsen weiter)

- Die produktive Nutzung von KI (ROI ist gegeben)

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Ausblick: die Post-Monopol-Ära

Das neue Gleichgewicht (2027 und folgende)

In der Zeit ab 2027 wird sich eine neue Marktordnung gebildet haben, die von großen Hyperscalern und konsolidierten Spezialisten dominiert wird.

Konkret bedeutet das für die Marktstruktur:

- Tier 1: 3-4 vertikal integrierte Giganten (Google, Amazon, Microsoft, Meta)

- Tier 2: Konsolidierte Spezialisten (Oracle, ausgewählte Überlebende)

- Tier 3: Nischen-Anbieter für spezifische Workloads

Auf dem Chip-Markt wird sich ebenfalls einiges verändern. Nvidia wird seine heute dominierende Stellung einbüßen:

- Nvidia: 40-50 Prozent Marktanteil statt mehr als 80 Prozent

- Custom Silicon: 30 bis 40 Prozent

- AMD/Intel: 10 bis 20 Prozent

Die Gewinner der Transformation

Daneben wird es einige unerwartete Profiteure geben:

- TSMC: Der Chip-Produzent fertigt für alle (Nvidia, Google, Amazon, Apple)

- Stromversorger verdienen durch langfristige Abnahmeverträge

- Anbieter von Kühlungs-Technologie: Liquid Cooling wird Standard

- EDA-Software: Jeder will eigene Chips designen

Was das für Investoren bedeutet

Wer sein Portfolio auf diese Entwicklungen ausrichten möchte, sollte klar differenzieren.

Verkaufen:

- Reine Nvidia-Wetten auf ewiges Wachstum sind riskant.

- Tier-2-Cloud-Anbieter ohne Differenzierung sind ebenfalls problematisch.

- KI-Startups ohne Produktivitäts-Nachweis stellen eine riskante Investition dar.

Halten/Kaufen:

- Hyperscaler mit eigenen Chips (Google, Amazon) sind eine sichere Bank.

- TSMC ist der wahre Gewinner der Chip-Diversifikation und damit ebenfalls ein guter Invest.

- Enterprise-Software mit KI-Integration wie Microsoft oder Salesforce dürfte sich weiterhin einer großen Nachfrage erfreuen.

Für einige Positionen lohnt es sich zu beobachten:

- OpenAI: Alles hängt am Chip-Projekt

- Oracle: Neutralitäts-Premium hat Grenzen

- AMD: Profitiert von Nvidia-Schwäche, die Frage ist aber, wie stark

Schlussplädoyer

Die Debatte „Platzt die KI-Blase?" stellt die falsche Frage. Die richtige Frage lautet: „Wer behält die Gewinne der KI-Revolution?"

Die Antwort ist klar: Die vertikal integrierten Plattform-Besitzer (Hyperscaler) haben durch Custom Silicon und lange Abschreibungszyklen die Kontrolle übernommen. Die „Blase" war nie eine Blase der Nachfrage oder der Wirtschaftlichkeit – sie war eine Blase der überhöhten Margen eines einzelnen Lieferanten.

Die technische Dokumentation zu Gemini 3 ist wichtiger als der nächste Nvidia-Quartalsbericht. Sie beweist, dass die technologische Abhängigkeit von Nvidia gebrochen wurde. Was folgt, ist keine Katastrophe, sondern eine Normalisierung: KI wird zur Commodity, die Margen sinken auf gesunde Niveaus, und die Investitionen zahlen sich über Jahre hinweg aus.

Wer heute noch auf das Platzen der KI-Blase wettet, wettet gegen den technologischen Fortschritt selbst. Die Hardware wird billiger, die Software besser, die Anwendungen produktiver. Das ist keine Blase – das ist eine Infrastruktur-Transformation wie einst der Übergang von Mainframes zu Cloud Computing.

Die Blase platzt nicht. Sie härtet aus und wird zum neuen Fundament der digitalen Ökonomie.

Fazit und abschließende Bewertung: KI-Blase ja oder nein?

Die Synthese der beiden Standpunkte führt zu der Erkenntnis, dass kein systemischer Kollaps der KI-Ökonomie wahrscheinlich ist, weil die zugrunde liegende Infrastruktur einen nachweisbaren ROI (Return-on-Investment) liefert. Eine notwendige Marktbereinigung ist dagegen zu erwarten.

Die mögliche Zukunft der KI-Investitionen lässt sich in drei Szenarien unterteilen:

1. Optimistisches Szenario (Aushärtung und Dominanz)

Dieses Szenario tritt ein, wenn die Argumente der optimistischen Sichtweise vollständig greifen und die KI-Investitionen ihren erwarteten makroökonomischen Effekt entfalten.

- Kernannahme: Die vertikale Integration der Hyperscaler (Google, Amazon, Meta) mittels eigener Chips (Custom Silicon) gelingt vollständig, wodurch die internen Kosten dramatisch gesenkt werden.

- Folgen: Die verlängerten Abschreibungszyklen wandeln Milliarden an CapEx in operativen Gewinn um. Der Business Case für Endkunden ist robust, weil die Produktivitätssteigerungen die geringen Kosten um ein Vielfaches übertreffen. Die zweite Welle der KI-Monetarisierung (z. B. autonomes Fahren, personalisierte Medizin) startet erfolgreich.

- Ausblick: KI führt zu einem signifikanten Anstieg des globalen BIP und beschleunigt das Produktivitätswachstum. Die Infrastruktur härtet als neues Fundament der digitalen Ökonomie aus.

2. Pessimistisches Szenario (Kapitalvernichtung und KI-Winter)

Dieses Szenario basiert auf den kritischsten Argumenten der Blasen-These, insbesondere dem Fehlen des nachweisbaren ROI auf der Anwendungsebene.

- Kernannahme: Der notwendige Durchbruch bei der Monetarisierung im B2B-Bereich gelingt nicht innerhalb der nächsten 24 Monate. Es herrscht weiterhin die sogenannte „GenAI Divide".

- Folgen: Die zirkuläre Finanzierung bricht zusammen, wenn Risikokapital versiegt, wodurch Startups ihre Cloud-Rechnungen nicht mehr bezahlen können. Das führt zu Umsatzwarnungen bei den Cloud-Providern, da die Abschreibungen nicht gedeckt sind. Physische Engpässe wie Energieknappheit führen zu „Stranded Assets".

3. Realistisches Szenario (Normalisierung und Konsolidierung)

Dieses Szenario stellt die wahrscheinliche Synthese dar: Die Infrastruktur bleibt intakt, aber überhöhte Bewertungen und undifferenzierte Geschäftsmodelle kollabieren.

- Kernannahme: Die lokale Marktbereinigung findet statt. Auslöser ist der Verlust der technologischen Abhängigkeit der Hyperscaler von Nvidia.

- Folgen: Nvidias Monopol-Margen erodieren. Tier-2-Cloud-Anbieter (reine GPU-Vermieter) erleiden Pleiten und erfahren eine Konsolidierung, weil ihre kreditfinanzierte Hardware schneller an Wert verliert, als sie amortisiert werden kann. Die Hyperscaler-Geschäfte bleiben stabil, weil ihre CapEx-Rechnung dank interner Effizienzmaßnahmen aufgeht.

- Ausblick: Der Markt ordnet sich in eine Post-Monopol-Ära um, dominiert von vertikal integrierten Giganten und konsolidierten Spezialisten wie Oracle und TSMC. KI wird zu einer Commodity, was den Wettbewerb und gesunde Margen fördert.

Wichtiger Rechtlicher Hinweis / Haftungsausschluss (Disclaimer)

Keine Anlageberatung Die in diesem Artikel, Analyse-Paper und den dazugehörigen Grafiken enthaltenen Informationen, Meinungen und Prognosen dienen ausschließlich zu Informations- und Bildungszwecken. Sie stellen keine Anlageberatung, keine Empfehlung zum Kauf oder Verkauf von Wertpapieren (wie Aktien von Nvidia, Alphabet, Amazon, Microsoft etc.) und keine Aufforderung zum Handeln dar.

Subjektive Meinung & Szenario-Analyse Die Inhalte spiegeln lediglich die persönliche Meinung und die subjektive Marktanalyse der Autoren zum Zeitpunkt der Veröffentlichung wider. Insbesondere die dargestellten Szenarien für die Jahre 2026 und 2027 basieren auf theoretischen Modellen und Annahmen über technologische Entwicklungen. Diese Prognosen sind spekulativer Natur und können sich als unzutreffend erweisen.

Eigenverantwortung Investitionen an den Finanzmärkten sind mit Risiken verbunden, die bis zum Totalverlust des eingesetzten Kapitals führen können. Jede Investitionsentscheidung treffen Sie eigenverantwortlich und auf eigenes Risiko. Wir übernehmen keine Haftung für finanzielle Verluste oder Schäden, die direkt oder indirekt durch die Nutzung der hier bereitgestellten Informationen entstehen. Bitte konsultieren Sie vor finanziellen Entscheidungen einen qualifizierten Finanzberater oder Steuerberater, um Ihre individuelle Situation zu prüfen.

Weitere Artikel

GPT Image 1.5 ist da: OpenAIs Antwort auf Google Nano Banana Pro

OpenAI hat mit einer neuen Version von ChatGPT Images gegenüber Google nachgelegt und liefert mit GPT Image 1.5 ein

IT-Wartung: warum kein Unternehmen darauf verzichten kann

TL;DR: das Wichtigste in Kürze Die regelmäßige IT-Wartung ist eine Investition, die hohe Kosten durch Ausfallzeiten, Datenverlust und Cyberkriminalität

GPT-5.2: Befreiungsschlag für OpenAI?

Verschafft das Release von GPT-5.2 OpenAI Luft im Wettbewerb mit Google und Anthropic? Nachdem Google im November mit Gemini 3

Zum Inhalt springen

Zum Inhalt springen