Unternehmen, die KI einsetzen möchten, müssen entscheiden, ob sich die Anschaffung eigener KI-Infrastruktur lohnt, oder ob es günstiger ist, fertige Lösungen einzukaufen.

KI ist angekommen – und jetzt?

KI ist inzwischen in vielen Unternehmen angekommen. Laut einer Bitkom-Studie aus 2025 setzen inzwischen 36 Prozent der deutschen Unternehmen mit mehr als 20 Beschäftigten KI produktiv ein. Das ist fast doppelt so viel wie noch ein Jahr zuvor. Der KfW-Fokusbericht zum Mittelstand vom Februar 2026 bestätigt den Trend: Rund 780.000 mittelständische Betriebe haben KI-Technologien in ihre Abläufe integriert – fünfmal so viele wie vor sechs Jahren.

Diese Dynamik bringt allerdings ein handfestes Problem mit sich. Weil viele Unternehmen noch keine zentrale, sichere KI-Infrastruktur bereitstellen, greifen Mitarbeiter zunehmend auf eigene Faust zu frei verfügbaren KI-Tools – ein Phänomen, das Bitkom als „Schatten-KI" beschreibt. Das geschieht oft ohne Wissen der IT-Abteilung und umgeht systematisch Compliance-Richtlinien. Geistiges Eigentum und DSGVO-Konformität stehen auf dem Spiel.

Genau hier wird die Make-or-Buy-Frage strategisch: Sollen Unternehmen eigene KI-Infrastruktur aufbauen oder auf Cloud-Dienste setzen? Die Antwort ist komplexer, als man denkt, und sie hat massive Auswirkungen auf Kosten, Wettbewerbsfähigkeit und Datenschutz.

Warum sich KI-Investitionen lohnen

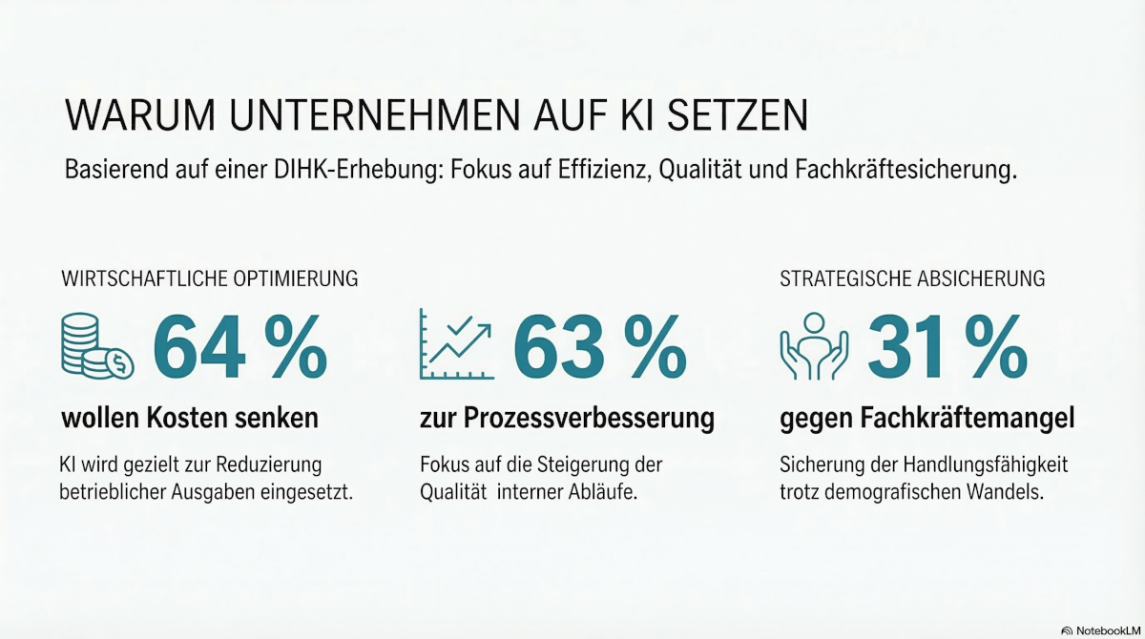

Die Gründe für den KI-Einsatz sind handfest. Eine Erhebung der DIHK zeigt: 64 Prozent der Unternehmen wollen mit KI Kosten senken, 63 Prozent ihre Prozessqualität verbessern. Und angesichts des demografischen Wandels sehen 31 Prozent KI als Mittel, um trotz Fachkräftemangel handlungsfähig zu bleiben. Die Bitkom-Studie ergänzt: KI-Systeme übernehmen zunehmend repetitive Routinetätigkeiten und setzen damit Kapazitäten frei für strategische und kreative Aufgaben. Das führt paradoxerweise trotz Automatisierung zu einer Aufwertung der menschlichen Arbeit.

Dabei geht es längst nicht nur um Effizienz. 36 Prozent der von der DIHK befragten Unternehmen nutzen KI bereits für völlig neue, datengetriebene Produkte und Dienstleistungen. Predictive Maintenance optimiert die Instandhaltung: KI wertet Sensordaten in Echtzeit aus, erkennt Anomalien und verhindert ungeplante Stillstände. Und auf makroökonomischer Ebene projiziert die KfW, dass das deutsche BIP bei flächendeckender KI-Verbreitung bis 2037 um rund 12,8 Prozent höher ausfallen könnte als ohne diese Technologie.

Dazu kommt ein Paradigmenwechsel, den Gartner und die Boston Consulting Group für 2025/2026 beschreiben: der Übergang hin zur „Agentic AI". KI-Agenten planen selbstständig mehrstufige Abläufe, interagieren mit Drittsystemen und führen Transaktionen eigenständig aus. Laut BCG erzielen Unternehmen, die solche Architekturen früh skalieren, fünfmal höhere Umsatzsteigerungen und dreimal stärkere Kostenreduktionen als Nachzügler. Die Wertschöpfungslücke wächst exponentiell – und damit der Druck, die richtige Infrastruktur zu wählen.

Was „Make" und „Buy" im KI-Kontext bedeuten

Im Gegensatz zur klassischen Softwareentwicklung sind bei KI Algorithmen, Trainingsdaten und Hardware eng miteinander verzahnt. Diese Verflechtung macht die Make-or-Buy-Entscheidung besonders komplex. Schauen wir uns die Optionen genauer an.

„Make": Eigene KI-Infrastruktur betreiben

„Make" heißt nicht, KI von Null zu entwickeln. Es bedeutet, dass Hardware, Datenhoheit und technische Orchestrierung vollständig im Unternehmen verbleiben. Das Fundament bilden GPU-Cluster mit spezialisierten Prozessoren. Darauf läuft eine Private-Cloud-Umgebung, in der Teams leistungsfähige Open-Source-Modelle wie LLaMA oder Mistral importieren, mit firmeneigenen Daten verfeinern und so hochspezialisierte Werkzeuge schaffen, deren geistiges Eigentum vollständig beim Unternehmen liegt.

Der operative Aufwand ist allerdings erheblich. Es braucht zum Beispiel Kompetenz in MLOps und Kubernetes-Orchestrierung, eine adäquate Kühlung (ein einziger 8x-B200-Knoten verbraucht laut Benchmarks bis zu 7 Kilowatt unter Volllast) und ein Team, das Versionierung, Monitoring und automatisiertes Retraining beherrscht.

„Buy": KI als Service beziehen

Beim Buy-Ansatz übernehmen Hyperscaler wie AWS, Azure oder Google Cloud die gesamte Infrastruktur. Unternehmen zahlen nutzungsabhängig – oft pro Million verarbeiteter Tokens. Das gibt es in drei Abstufungen:

- API-Modelle von Anbietern wie OpenAI oder Anthropic

- fertige SaaS-Lösungen wie Microsoft Copilot oder Salesforce Einstein

- ML-Plattformen wie Amazon SageMaker, auf denen eigene Modelle trainiert werden können.

Der Vorteil: kein Kapitalaufwand, sofortiger Zugang zu den neuesten Frontier-Modellen und nahezu unendliche Skalierbarkeit. Die Nachteile: keine Einsicht in Architektur oder Trainingsdaten, kaum Möglichkeit zur Differenzierung gegenüber dem Wettbewerb – und das Risiko, dass die Kosten bei intensiver Nutzung durch die Decke gehen.

Hybride Modelle: Das Beste aus beiden Welten

In der Praxis dominieren Mischformen. Hybride Architekturen kombinieren eine lokale Grundlast-Infrastruktur mit automatisiertem Cloud Bursting bei Lastspitzen. Das eigene Rechenzentrum übernimmt die tägliche Basis-Inferenz und das iterative Training. Steigt der Bedarf plötzlich – etwa durch ein massives Retraining –, orchestriert Kubernetes automatisch zusätzliche GPU-Instanzen in der Cloud. Nach Abschluss werden sie sofort wieder terminiert. So vermeidet man teures Über-Provisionieren, ohne auf Flexibilität zu verzichten.

Ein weiteres Muster sind föderierte Modelle: Sensible Daten bleiben lokal, werden dort aufbereitet und anonymisiert. Nur die bereinigten Feature-Vektoren wandern zum Training in die Cloud. Das fertige Modell kommt anschließend zurück in die gesicherte Unternehmensumgebung. So lässt sich Rechenpower nutzen, ohne die Datensouveränität zu gefährden.

Vier Gründe für eigene KI-Infrastruktur

1. Datenschutz und Datensouveränität

Für europäische Unternehmen steht das Thema ganz oben auf der Agenda. DSGVO, NIS2, DORA und der EU AI Act bilden den Rechtsrahmen. Gleichzeitig erlaubt der US CLOUD Act US-Behörden unter bestimmten Bedingungen den Zugriff auf Daten bei amerikanischen Cloud-Anbietern – egal, ob die Server physisch in Frankfurt oder Stockholm stehen. Wer sensible Daten verarbeitet, steht vor einem echten Jurisdiktionskonflikt. On-Premise löst dieses Problem: Der Datenfluss verlässt nie den physischen Perimeter des Unternehmens, und regulatorische Compliance ist lückenlos gewährleistet.

2. Kostenkontrolle bei steigenden Volumina

Das Pay-as-you-go-Modell der Cloud ist bei niedriger Auslastung ökonomisch sinnvoll. Doch mit wachsenden Token-Volumina eskalieren die Kosten schnell. IT-Ökonomen bezeichnen unkontrolliertes Cloud-Wachstum zunehmend als „finanzielle technische Schulden". Und das Problem ist verbreitet: Untersuchungen zeigen, dass 31 Prozent der IT-Leiter berichten, mehr als die Hälfte ihrer Cloud-Ausgaben sei verschwendet, weil Instanzen für Lastspitzen überprovisioniert und nicht zurückgefahren werden. Eigene Infrastruktur wandelt diese unüberschaubaren variablen Kosten in planbare, abschreibungsfähige Fixkosten um.

3. Massive Skaleneffekte bei Dauerbetrieb

Hier wird es richtig spannend. Die Lenovo TCO Edition 2026 zeigt: Ab einer kontinuierlichen Inferenz-Auslastung von über 20 Prozent amortisiert sich On-Premise-KI-Hardware gegenüber der Cloud häufig in weniger als vier Monaten. Über einen Standard-Lebenszyklus von fünf Jahren können die kumulierten Einsparungen pro Server-Rack im Millionenbereich liegen.

4. Performance und strategische Unabhängigkeit

Cloud-Umgebungen bringen systembedingte Netzwerklatenzen mit sich. Für Echtzeit-Anwendungen in Robotik, Hochfrequenzsteuerung oder industrieller Sensorik kann das ein Ausschlusskriterium sein. Benchmarks zeigen: Ein lokal gehosteter B200-Cluster erreicht bei Computer-Vision-Training bis zu 57 Prozent höhere Geschwindigkeiten als Cloud-basierte H100-Instanzen. Der Grund: Der massive 192 GB HBM3e-Speicher lässt sich ohne Virtualisierungs-Overhead voll ausreizen.

Dazu kommt das Thema Vendor Lock-in. Wer seine kognitive Kernkompetenz vollständig an einen einzelnen Cloud-Anbieter bindet, macht sich abhängig von dessen Preispolitik, API-Änderungen und Produktabkündigungen. Eigene Infrastruktur garantiert dagegen die volle Kontrolle über das geistige Eigentum und die Freiheit, Modelle nach eigenen Kriterien weiterzuentwickeln.

Wann lohnt sich Make, wann Buy? Ein Kostenvergleich

Der entscheidende Wandel in der Infrastrukturbewertung 2026: Nicht mehr FLOPS sind die Leitmetrik, sondern die Token-Ökonomie, also die Kosten pro generiertem Token. Je nach Nutzungsvolumen ergibt sich ein klares Bild:

Leichte Nutzung (unter 1 Mio. Token pro Tag): Typisch für Prototypen, Proof-of-Concepts und erste Experimente. Bei eigener Hardware dominieren die Fixkosten. Ein interaktives Kostenmodell verdeutlicht das: Bei 50 Stunden Nutzung pro Monat liegen Cloud-APIs bei rund 37 USD, während lokale Hardware etwa 1.750 USD plus Strom kostet. In dieser Phase ist die Cloud betriebswirtschaftlich klar überlegen.

Mittlere Nutzung (1 bis 10 Mio. Token pro Tag): Hier beginnen die TCO-Kurven zu konvergieren. Bei einer Dauernutzung von 200 bis 400 Stunden pro Monat kippt die Kalkulation zunehmend zugunsten lokaler Setups. Hybride Übergangslösungen sind in dieser Phase oft der kluge Mittelweg.

Schwere Nutzung und Modelltraining: Wer kontinuierlich große Modelle inferenziert oder eigene Foundation Models feintunt, fährt mit der Cloud finanziell vor die Wand. Die Betriebskosten eines B200-Systems im Self-Hosting liegen bei etwa 0,51 USD pro GPU-Stunde. Cloud-Instanzen kosten dagegen zwischen 2,95 und über 16 USD – ein Faktor von 6 bis 30.

Vier Entscheidungsfaktoren für Ihre Strategie

Unternehmensgröße und Ressourcen

Kleine Mittelständler haben selten die Liquidität für sechsstellige Vorabinvestitionen und kämpfen zudem mit dem Fachkräftemangel beim Aufbau von MLOps-Teams. Für sie sind Cloud-APIs und SaaS der primäre Zugang zur Technologie. Größere Unternehmen mit etablierten IT-Teams und eigener Forschung können dagegen durch eigene Rechenzentren langfristig Skaleneffekte und Souveränität erzielen. Die KfW-Daten belegen den Zusammenhang deutlich: Unternehmen mit kontinuierlicher FuE und expliziter Digitalisierungsstrategie nutzen KI drei- bis fünfmal häufiger als solche ohne.

Reifegrad der KI-Strategie

Das Framework von appliedAI stellt zwei entscheidende Fragen: Birgt der Use Case echte Wettbewerbsvorteile? Und verfügt das Unternehmen über einzigartige Daten, um Modelle besser zu trainieren als die Konkurrenz? Liegt der Anwendungsfall im Kern des Geschäftsmodells und die Antwort ist zweimal Ja, ist Make strategisch geboten. Für Standardprozesse wie Spesenabrechnung oder IT-Support lohnt sich der Eigenbau dagegen schlicht nicht.

Datenstrategie und Regulierung

Unterliegen die zu verarbeitenden Daten massiven regulatorischen Restriktionen (KRITIS, NIS2) oder sind die Datenmengen so groß, dass ein Cloud-Transfer zu langsam und teuer wäre? Dann muss die Infrastruktur zu den Daten kommen, nicht umgekehrt. Die Bereitstellung von „AI-ready data" ist neben der Technologie selbst der kritischste Erfolgsfaktor für KI-Projekte.

Skalierungsbedarf und Vorhersagbarkeit

Planbar wachsende Inferenzlasten, etwa durch die Integration eines LLM in ein B2C-Produkt, sprechen für On-Premise, das gegen explodierende variable Kosten absichert. Volatile, unvorhersehbare Bedarfe dagegen, typisch für Startups oder experimentelle Projekte, sprechen für die Elastizität der Cloud, die bei Scheitern sofort abgeschaltet werden kann.

Wie deutsche Unternehmen es machen: Vier Praxisbeispiele

BASF – Der Enterprise-Hybrid-Ansatz: Der Chemiekonzern verfolgt laut seinem Unternehmensbericht einen „Make & Buy"-Ansatz in der digitalen Transformation seiner globalen Forschung. R&D-Teams entwickeln spezialisierte chemische Modelle mit proprietären Daten lokal, greifen bei Bedarf aber auf externe Hochleistungsrechner zu. So bleiben Innovationszyklen schnell, ohne die Hoheit über sensible Forschungsdaten aufzugeben.

Zahnen Technik – KI im Mittelstand: Das Familienunternehmen aus Rheinland-Pfalz, spezialisiert auf Wasser- und Abwasserbehandlung, zeigt, wie KI-Integration auch schlank funktioniert. Mit „Cloud Control by zahnen" integrierten sie intelligente Algorithmen in ihr Prozessleitsystem. Die KI erkennt drohende Pumpenverstopfungen und realisiert massive Energiesparpotenziale. Der Schlüssel zum Erfolg: kleine Pilotprojekte, tiefes internes Domänenwissen plus externe KI-Softwarekompetenz.

Braun – Maximale Prozesssicherheit: Der Medizintechnikkonzern setzt laut seiner Unternehmenswebsite maschinelles Lernen zur Unterstützung bei der Reparatur von Dialysegeräten und zur automatisierten Defekterkennung in der Fertigung ein. Da hier hochsensible Produktions- und Qualitätsdaten verarbeitet werden, ist die enge Kontrolle über die trainierten Modelle und die gesicherte Verarbeitungsumgebung nicht verhandelbar – ein klarer Make-Ansatz bei den Algorithmen.

Deutsche Telekom / T-Systems – Sovereign Cloud für Deutschland: Mit der ersten „Industrial AI Cloud" in München adressiert T-Systems das Dilemma vieler Mittelständler: zu wenig Kapital für eigene GPU-Cluster, aber zu strenge regulatorische Anforderungen für US-Hyperscaler. Kunden trainieren hier KI-Modelle mit der Agilität einer Public Cloud, aber unter dem rechtlichen Schirm europäischer Datensouveränität.

Was Sie jetzt konkret tun sollten

Denken Sie in Phasen, nicht in Entweder-Oder

Das Zartis-Maturity-Framework empfiehlt einen evolutionären Dreischritt: Starten Sie mit Cloud-APIs und SaaS (Buy), um schnell Mehrwerte zu generieren und den Business Case zu validieren. Gehen Sie dann zu hybriden Strukturen über, die sensible Daten isolieren, während Rechenleistung föderiert aus der Cloud bezogen wird. Ziehen Sie erst dann Kern-Workloads auf eigene Hardware, wenn die Token-Volumina exponentiell steigen und die algorithmische Differenzierung gegenüber dem Wettbewerb es verlangt.

Vermeiden Sie Vendor Lock-in von Anfang an

Setzen Sie auf offene Standards, Containerisierung mit Kubernetes und quelloffene Basismodelle. So bleibt eine Migration zwischen Cloud und On-Premise jederzeit technisch und wirtschaftlich machbar.

Investieren Sie in Menschen, nicht nur in Hardware

Der Fachkräftemangel ist eine der größten Barrieren für den KI-Einsatz im Mittelstand. Ein teurer GPU-Cluster ohne ein Team, das Container orchestrieren, Modelle auf Daten-Drift überwachen und KI-Governance sicherstellen kann, ist eine Fehlinvestition. Budgets für Infrastruktur müssen durch erhebliche Investitionen in die Weiterbildung der Belegschaft flankiert werden.

Etablieren Sie stringentes Ressourcen-Management

Wer eigene Hardware betreibt, muss sie optimal auslasten. Komplexe Trainingsaufgaben gehören auf neue GPUs, Inferenz kann auf älteren Systemen laufen. Und ein einheitliches Monitoring, das technische Auslastung und Kosten über alle Umgebungen in Echtzeit erfasst, ist keine Kür, sondern Pflicht.

Fazit: Die Frage ist nicht ob, sondern wie

Die Make-or-Buy-Entscheidung bei KI-Infrastruktur ist für viele Unternehmen eine weitreichende strategische Weichenstellung. Dabei gibt ex kein reines Entweder-Oder.

Für Standardanwendungen, schnelles Prototyping und den agilen Markteintritt bleibt der Buy-Ansatz das Mittel der Wahl. Je tiefer KI aber in die kritischen Kernprozesse eindringt – in Anlagensteuerung, Produktentwicklung, geistiges Eigentum –, desto zwingender wird der Bedarf an eigener oder zumindest souverän kontrollierter Infrastruktur. Strikte europäische Regulierung, explodierende Cloud-Kosten bei Vollauslastung und das Gebot der Datensouveränität treiben diese Entwicklung.

Erfolgreiche Unternehmen werden künftig nicht an der Zahl ihrer KI-Use-Cases gemessen, sondern an ihrer architektonischen Intelligenz: die grenzenlose Agilität der Cloud für Lastspitzen nutzen, die ökonomische Effizienz und Souveränität eigener Hardware für die Grundlast orchestrieren – und dabei die Total Cost of Ownership über den gesamten Lebenszyklus im Griff behalten. Das ist das Fundament für nachhaltiges, profitables Wachstum in der KI-getriebenen Wirtschaft.

Make or Buy von KI-Infrastruktur: FAQs

Ab wann rechnet sich eigene KI-Hardware gegenüber der Cloud?

Bei einer kontinuierlichen GPU-Auslastung von über 20 Prozent amortisiert sich On-Premise-Infrastruktur häufig bereits in weniger als vier Monaten.

Was ist das größte rechtliche Risiko bei der Nutzung US-amerikanischer Cloud-KI-Dienste?

Der Jurisdiktionskonflikt zwischen DSGVO und US CLOUD Act, der US-Behörden potenziell Zugriff auf in Europa gespeicherte Unternehmensdaten gewährt – unabhängig vom physischen Serverstandort.

Wie lässt sich Vendor Lock-in bei Cloud-KI vermeiden?

Durch den Einsatz offener Standards, die Containerisierung von Workloads und die Bevorzugung quelloffener Basismodelle, die eine Migration jederzeit technisch und wirtschaftlich machbar halten.

Welche Infrastruktur-Strategie eignet sich für KMU beim KI-Einstieg?

KMU sollten mit dem Buy-Ansatz (Cloud-APIs oder SaaS) starten, um schnell Mehrwerte zu erzielen und den Business Case zu validieren, bevor sie in hybride oder eigene Architekturen investieren.

Was genau ist „Cloud Bursting" bei hybriden KI-Architekturen?

Die eigene On-Premise-Hardware deckt die stetige KI-Grundlast ab, während bei unvorhersehbaren Lastspitzen automatisiert und temporär zusätzliche GPU-Kapazitäten aus der Public Cloud zugeschaltet werden.

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Weitere Artikel

Google Gemini 3.1 Pro ist da: Spitzenreiter in vielen Benchmarks

Mit Gemini 3.1 Pro präsentiert Google die nächste Generation seiner Gemini-Modellreihe, die als das bisher fortschrittlichste Modell des Unternehmens für

Von OpenClaw zu OpenAI: Warum Europa seine KI-Talente verliert – Plus: 5 neue China-Modelle im Check

️ Über diese Episode Peter Steinbergers Wechsel von OpenClaw zu OpenAI ist mehr als eine Personalentscheidung – es

KI-Pakt zwischen Deutschland und Indien beschlossen

Deutschland und Indien haben ihre strategische Partnerschaft auf eine neue Ebene gehoben. Am Rande des AI Impact Summit in Neu-Delhi

Zum Inhalt springen

Zum Inhalt springen