Das OpenWorldLib Framework schafft Orientierung bei der Frage, wie World Models zu definieren sind und was sie können müssen.

In der KI rückt ein Konzept zunehmend ins Rampenlicht: die World Models. Obwohl es auf diesem Gebiet große Fortschritte gibt, fehlte es bisher an einer klaren, einheitlichen Definition und einer standardisierten technischen Grundlage. Zur besseren Einordnung wurde OpenWorldLib entwickelt: ein umfassendes und standardisiertes Inferenz-Framework für fortschrittliche World Models (Originaltitel: “OpenWorldLib: A Unified Codebase and Definition of Advanced World Models”).

Im Folgenden werfen wir einen detaillierten Blick auf die genaue Definition dieser Modelle, ihre Abgrenzung zu anderen Technologien, die Architektur des OpenWorldLib-Frameworks, das experimentelle Setup sowie eine abschließende Bewertung der zukünftigen Entwicklungen.

Der Ansatz: Wie werden World Models eigentlich definiert?

Der Begriff des „World Models“ wird in der Forschung oft sehr unterschiedlich verwendet, was zu erheblicher Verwirrung geführt hat. OpenWorldLib setzt hier an und liefert eine präzise Definition, die auf dem Kernziel dieser Systeme basiert: der Fähigkeit, kontinuierlich aus der realen Welt zu lernen und mit ihr zu interagieren. Ein World Model wird daher definiert als ein Modell oder Framework, dessen Zentrum die auf Wahrnehmung basierende Erstellung interner Repräsentationen ist. Es muss zwingend mit Fähigkeiten zur aktionsbedingten Simulation und einem Langzeitgedächtnis ausgestattet sein, um die Dynamiken einer komplexen Welt zu verstehen und vorherzusagen.

Ein World Model ist nicht an eine spezifische Architektur oder eine isolierte Aufgabe gebunden, sondern stellt vielmehr ein übergeordnetes Leistungsniveau dar.

Mathematisch und konzeptionell stützen sich World Models traditionell auf drei fundamentale Wahrscheinlichkeitsverteilungen:

- Das Zustandsübergangsmodell (State Transition Model), das den nächsten latenten Zustand basierend auf dem aktuellen Zustand und der durchgeführten Aktion vorhersagt. Dieser Zustand integriert ein intrinsisches Gedächtnis, um langfristige Abhängigkeiten bei komplexen Aufgaben zu verwalten.

- Das Beobachtungsmodell (Observation Model), das die sensorische Wahrnehmung (z. B. visuell, auditiv oder propriozeptiv) aus dem jeweiligen Zustand ableitet.

- Das Belohnungsmodell (Reward Model), welches das Feedback oder die Belohnung aus der Interaktion zwischen den Aktionen und der Umgebung berechnet.

Was nach dieser Definition zu den World Models gehört

Basierend auf der strengen Definition von OpenWorldLib lassen sich spezifische Aufgaben identifizieren, die eindeutig in den Bereich der World Models fallen, weil sie tiefgreifendes Verständnis und Interaktion mit der physikalischen Welt erfordern.

Interaktive Videogenerierung

Die Vorhersage des nächsten Bildes (Next-Frame Prediction) gilt als eines der bekanntesten Paradigmen in der World-Model-Forschung. Es geht dabei um die aktive, interaktive Erstellung von Videosequenzen basierend auf Nutzereingaben und Umgebungsdynamiken. Beispiele dafür sind frühe regressive Modelle wie Matrix-Game-2 oder neuere, auf Diffusionsmodellen basierende Ansätze wie Lingbot-World, Hunyuan-GameCraft, YUME-1.5, Cosmos und WoW. Auch Wan-IT2V gehört dazu, wenngleich es noch Schwierigkeiten hat, physikalische Konsistenzen bei interaktiven Operationen aufrechtzuerhalten.

Multimodales Schlussfolgern (Reasoning)

Ein echtes World Model muss die komplexe physikalische Welt nicht nur sehen, sondern tiefgreifend verstehen. Das umfasst räumliches, zeitliches und kausales Schlussfolgern. Die Modelle müssen hochdimensionale und kontinuierliche Informationen verarbeiten. Daher verlagert sich die Forschung zunehmend auf latente Schlussfolgerungen. Ein konkretes Beispiel für ein System, das multimodales Reasoning und Generierung erfolgreich kombiniert, ist Bagel, das auf der Architektur des Sprachmodells Qwen aufbaut.

Vision-Language-Action (VLA)

Weil das Ziel von World Models die Interaktion von physischen Geräten wie Robotern oder autonomen Fahrzeugen mit der realen Umgebung ist, gehört VLA zu den absoluten Kernkompetenzen. VLA-Modelle übersetzen visuelle und sprachliche Inputs in konkrete physische Aktionen. Konkrete Beispiele, die im Framework getestet wurden, sind das Modell π0 und dessen Weiterentwicklung π0.5, welche die Vision-Language-Basis „PaliGemma“ nutzen, sowie LingBot-VA, das kontinuierliche Aktionssynthesen mit Videodiffusion kombiniert.

3D-Repräsentation und Simulatoren

Um sicherzustellen, dass die physischen Regeln während einer Langzeitinteraktion konsistent bleiben, nutzen World Models häufig 3D-Geometrien und Simulatoren. Das verhindert, dass Objekte verschwinden oder Räume sich unlogisch verändern, wenn ein Agent sich bewegt. Modelle, die diese Aufgabe übernehmen, sind beispielsweise VGGT, InfiniteVGGT und OmniVGGT, die Bilder in reale geometrische Strukturen übersetzen.

Auch Systeme zur schnellen Generierung von 3D-Szenen wie FlashWorld und die Hunyuan3D-Serie sind wichtig, weil sie dem World Model einen interaktiven „Sandkasten“ für Tests bieten. Als Simulationsumgebungen für verkörperte KI dienen Plattformen wie AI2-THOR und LIBERO.

Was ausdrücklich NICHT zu den World Models gehört

Viele moderne KI-Aufgaben werden fälschlicherweise als World Models bezeichnet, nur weil sie ähnliche Datenstrukturen oder Outputs verwenden. OpenWorldLib zieht hier eine klare Grenze:

Reine Text-zu-Video-Generierung (z.B. Sora)

Als das Modell “Sora” von OpenAI veröffentlicht wurde, nannten es viele einen „Welt-Simulator“. OpenWorldLib widerspricht dem ausdrücklich. Die Ausgabe eines Videos macht ein Modell nicht zu einem World Model. Was Sora fehlt, ist der multimodale Input zur Analyse der Umgebung und die echte Interaktion. Ohne die Fähigkeit, komplexe physikalische Regeln aktiv zu verstehen und auf Eingriffe zu reagieren, bleibt es ein reines Generierungswerkzeug.

Code-Generierung und Web-Suche

Modelle in diesen Bereichen nutzen zwar oft Strukturen für Langzeitinteraktionen, die von World Models entlehnt sind. Ihnen fehlt jedoch völlig der Bezug zur physikalischen Realität. Sie verarbeiten keine multimodalen Umwelteinflüsse und fallen somit aus der Definition heraus.

Avatar-Videogenerierung

Auch wenn Systeme zur Avatar-Videogenerierung multimodale Eingaben verarbeiten und über längere Zeiträume agieren, zielen sie primär auf Unterhaltung ab. Sie haben nichts mit der Erforschung oder dem grundlegenden Verständnis einer komplexen physischen Umgebung zu tun und sind daher keine World Models.

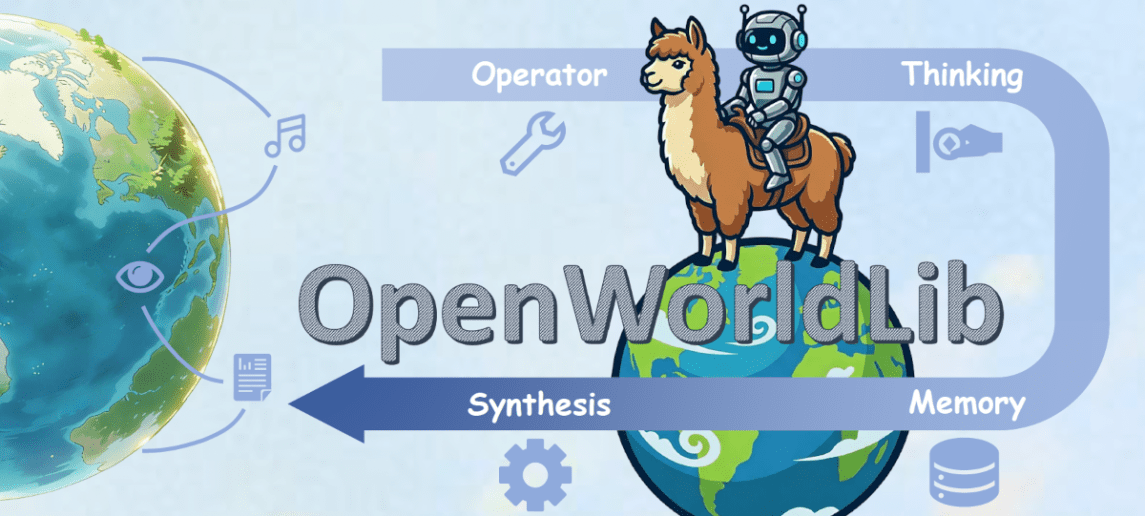

Die Architektur von OpenWorldLib: ein modularer Ansatz

Weil echte World Models eine enorme Bandbreite an komplexen Fähigkeiten benötigen, muss ihr Einsatz systematisch orchestriert werden. OpenWorldLib bietet dafür ein stark entkoppeltes, modulares Framework. Es ermöglicht, verschiedenste Modelle unter einer einheitlichen API zusammenzufassen. Die Architektur gliedert sich in die folgenden, klar definierten Einzelmodule:

Das Operator-Modul

Dieses Modul dient als die wichtigste Brücke und als Torwächter zwischen den rohen Eingaben aus der Umwelt oder vom Nutzer und den internen Berechnungen des Frameworks. Ein World Model muss völlig unterschiedliche Datenströme verarbeiten, seien es Textanweisungen, Bilder, kontinuierliche Steuerungsaktionen oder Audiosignale. Das Operator-Modul ist für die Standardisierung zuständig. Es übernimmt zwei Hauptaufgaben: Erstens die Validierung, um sicherzustellen, dass die Formate, Formen und Datentypen den strengen Anforderungen der nachgelagerten KI-Modelle entsprechen. Zweitens die Vorverarbeitung (Preprocessing), bei der rohe Signale in strukturierte Tensoren umgewandelt werden, beispielsweise durch das Zuschneiden von Bildern, das Tokenisieren von Texten oder das Normalisieren von Aktionsräumen.

Das Synthesis-Modul

Das Synthesis-Modul ist das kreative Herzstück des Frameworks und repräsentiert das sogenannte „implizite Gedächtnis“ des World Models. Hier werden die erlernten internen Dynamiken genutzt, um Reaktionen der Umwelt zu simulieren und sensorisches Feedback zu erzeugen. Dieses Modul teilt sich in drei hochspezialisierte Unterkategorien auf:

- Die Visuelle Synthese wandelt textuelle oder szenenbasierte Vorgaben in sichtbare Vorhersagen um, also in Bilder oder Videosequenzen. Das ist notwendig, um alternative Zukünfte in einem Simulator sichtbar zu machen.

- Die Audio-Synthese generiert kontinuierliche Wellenformen, damit die Welt nicht stumm bleibt; sie erzeugt Umgebungsgeräusche, die synchron zu visuellen Ereignissen passen.

- Die Synthese anderer Signale (insbesondere VLA) ist der entscheidende Teil für die physische Verkörperung. Hier werden multimodale Kontexte in ausführbare physische Befehle und kinematische Zustände übersetzt, die direkt an Simulatoren oder Roboter-Hardware gesendet werden können, um den Regelkreis der Interaktion zu schließen.

Das Reasoning-Modul

Wahrnehmung allein reicht für ein World Model nicht aus; es muss die wahrgenommene Welt logisch durchdringen. Das Reasoning-Modul ist für das tiefe Verständnis der physikalischen Realität zuständig. Es zieht räumliche Beziehungen heran, integriert unterschiedlichste Kontextinformationen und erzeugt strukturierte semantische Interpretationen, bevor irgendeine Aktion ausgeführt wird. Das Modul ist in drei Zweige unterteilt:

- General Reasoning nutzt multimodale LLMs (MLLMs), um Text, Bild, Video und Ton einheitlich zu verarbeiten.

- Spatial Reasoning spezialisiert sich rein auf das 3D-Verständnis und die Lokalisierung von Objekten im Raum.

- Audio Reasoning analysiert und interpretiert auditive Signale.

Das Representation-Modul

Während das Synthesis-Modul auf internen, impliziten Wahrscheinlichkeiten basiert, ist das Representation-Modul für die Erstellung expliziter, von Menschen definierter Strukturen zuständig. Die reale Wahrnehmung wird hier in feste, greifbare 3D-Strukturen wie Punktwolken, Tiefenkarten und Kamerapositionen transformiert. Das Modul baut gewissermaßen den manuellen „Sandkasten“, eine verifizierbare Simulation, in der das World Model testen kann, ob seine geplanten physischen Aktionen in einem festen Koordinatensystem physikalisch überhaupt Sinn ergeben. Es unterstützt zudem Cloud-APIs, um diese Geometrien an externe Physik-Engines zu exportieren.

Das Memory-Modul

Ohne Gedächtnis kann keine langfristige Interaktion stattfinden. Das Memory-Modul dient als das persistente Zentrum des gesamten Systems. Es speichert kontinuierlich strukturierte Informationen aus der Wahrnehmung, den getroffenen Schlussfolgerungen, den generierten Outputs und den ausgeführten physischen Aktionen ab. Es verwaltet die Historie über zahlreiche Interaktionen hinweg und bietet Mechanismen, um genau den richtigen historischen Kontext für aktuelle Aufgaben abzurufen, das sogenannte Context Retrieval. Zudem ist es in der Lage, neue Zustände nach jedem Durchlauf der Pipeline zu aktualisieren und separate Gedächtnis-Sitzungen für unterschiedliche Aufgaben parallel zu verwalten.

Das Pipeline-Modul

Das Pipeline-Modul sorgt für die Orchestrierung der Module. Es kapselt den gesamten Datenfluss: Es nimmt den rohen Input entgegen, sendet ihn zur Prüfung an den Operator, fragt das Memory-Modul nach vergangenen Kontexten ab, orchestriert parallel das Reasoning, die Synthesis und die Repräsentation und gibt am Ende strukturierte Outputs zurück, während es gleichzeitig das Gedächtnis aktualisiert. Die Pipeline ermöglicht eine einfache Ein-Klick-Inferenz für Einzelaufgaben, unterstützt aber ebenso mehrstufige, kontinuierliche Interaktionen. Durch diese Kapselung wird eine saubere Trennung der Modul-Logik bei maximaler Effizienz der Datenübertragung garantiert.

Abbildung 1: OpenWorldLib Framework. Quelle: OpenWorldLib: A Unified Codebase and Definition of Advanced World Models

Das experimentelle Setup

Um die Leistungsfähigkeit und die Flexibilität des OpenWorldLib-Frameworks zu validieren, führten die Forscher umfangreiche Evaluationen durch. Das experimentelle Setup stützte sich hardwareseitig primär auf extrem leistungsstarke Grafikkarten, namentlich NVIDIA A800 (mit 80 GB VRAM) und NVIDIA H200 mit 141 GB VRAM.

Die Tests deckten die wichtigsten Fähigkeiten eines World Models ab:

Im Bereich der interaktiven Videogenerierung wurde getestet, ob Modelle auf Bewegungsbefehle (vor, zurück, links, rechts) und Kamerarotationen korrekt reagieren. Dabei zeigte sich, dass ältere Modelle wie Matrix-Game-2 bei langen Sequenzen unter Farbverschiebungen leiden, während moderne Modelle wie Hunyuan-WorldPlay herausragende visuelle Ergebnisse liefern.

Abbildung 2: OpenWorldLib: Beispiel für interaktive Videogenerierung. Quelle: OpenWorldLib: A Unified Codebase and Definition of Advanced World Models

Beim multimodalen Reasoning wurde evaluiert, wie gut das Framework Wahrnehmungen in fundierte Entscheidungen und Pläne umsetzen kann. Für die 3D-Generierung wurden Einzelbilder in 3D-Szenen transformiert. Obwohl Modelle wie VGGT verschiedene Perspektiven generieren konnten, zeigten sie bei starken Kamerabewegungen noch Schwächen hinsichtlich geometrischer Konsistenz und verschwommenen Texturen, während FlashWorld zwar extrem schnell war, aber Probleme mit scharfen Details hatte.

Besonders intensiv wurde die Vision-Language-Action (VLA) evaluiert. Hierbei nutzten die Forscher die Simulatoren AI2-THOR für fotorealistisches Rendering und LIBERO für reproduzierbare Roboter-Manipulationen. Modelle wie π0 und LingBot-VA zeigten hier ihre Fähigkeit, physikalische Dynamiken zu planen und robust auszuführen.

Abschließende Bewertung und Ausblick

OpenWorldLib leistet einen wesentlichen und dringend benötigten Beitrag zur KI-Forschung, indem es erstmals eine klare Trennlinie zieht, was ein World Model ist und was nicht. Es standardisiert die Art und Weise, wie multimodale Eingaben und Interaktionskontrollen verarbeitet werden, und schafft eine grundlegende Vergleichbarkeit für die Forschung.

Die Analyse im Rahmen des Frameworks offenbart jedoch auch kritische Herausforderungen für die Zukunft. Aktuell basieren viele Modelle auf der Vorhersage des nächsten Bildes (Next-Frame Prediction). Dabei wird nachgeahmt, wie Menschen sensorische Eingaben verarbeiten. Das steht jedoch im Konflikt mit der aktuellen Hardware-Architektur von Computern, die von Natur aus auf die Vorhersage des nächsten Tokens (Next-Token Prediction) optimiert ist. Selbst wenn Modelle versuchen, Bilder vorherzusagen, müssen die Daten in Tokens umgewandelt werden. Das ist sehr ineffizient. Um echte, flüssige World Models zu realisieren, wird es unweigerlich zu Hardware-Iterationen und Anpassungen der fundamentalen Transformer-Strukturen kommen müssen.

Gleichzeitig zeigt die erfolgreiche Nutzung von LLMs wie Qwen innerhalb von Systemen wie Bagel, dass textbasierte Modelle ein großes Potenzial besitzen, als Grundgerüst für World Models zu dienen. Die Zukunft der World Models wird daher stark von datenzentrierten Methoden abhängen, einschließlich der Synthese multimodaler Daten, domänenspezifischer Datenerweiterung und strikter Qualitätskontrollen.

OpenWorldLib stellt das theoretische Fundament und das praktische Werkzeug bereit, um KI in die Komplexität unserer physischen Realität zu führen.

Das OpenWorldLib Framework steht unter anderem bei Hugging Face und bei GitHub zum Download bereit.

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Weitere Artikel

ChatGPT Finance: Sollte man der KI Zugang zu seinen Bankkonten geben?

Das neue ChatGPT Finance verspricht Unterstützung bei der Verwaltung der Finanzen. Die Risiken der Nutzung sind allerdings erheblich. OpenAI hat

KI und die Sinnkrise: Auch die Profiteure sind betroffen

Die enormen Möglichkeiten der KI führen bei vielen Menschen zu Verunsicherung und der Frage nach dem Sinn. Das betrifft auch

Claude for Small Business: KI für kleine Unternehmen als Chance oder Risiko?

Künstliche Intelligenz hat den deutschen Mittelstand als tägliches Werkzeug in vielen Anwendungsbereichen erreicht. Für viele kleine Betriebe ist KI