Mit einem neuen Ansatz sollen Abweichungen bei der KI-Bildverarbeitung reduziert werden, ohne dass es zum sogenannten Whac-A-Mole-Dilemma kommt.

Der WRING-Ansatz (Weighted Rotational DebiasING) ist eine neuartige, vom MIT vorgestellte Methode zur Reduzierung von Bias in multimodalen Vision-Language-Modellen (VLMs) wie beispielsweise OpenCLIP. Es handelt sich um einen Post-Processing-Ansatz, der direkt auf bereits vortrainierte Modelle angewendet werden kann, ohne dass ein teures und ressourcenintensives Retraining von Grund auf erforderlich ist.

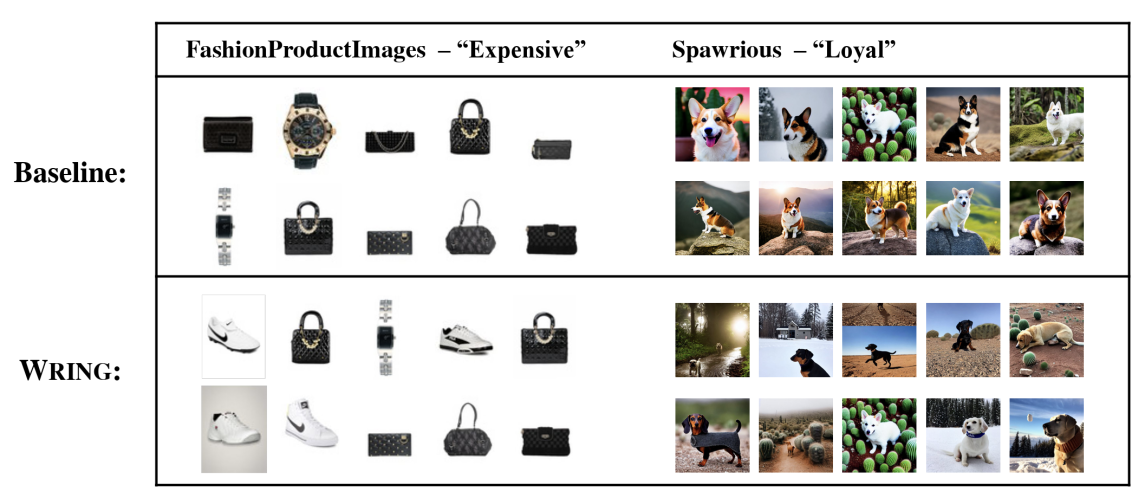

Technisch funktioniert WRING so, dass es bestimmte Koordinaten innerhalb des hochdimensionalen Raums eines Modells, die für den jeweiligen Bias verantwortlich sind, in einen anderen Winkel verschiebt, sie also rotiert. Durch diese gezielte Verschiebung verliert das Modell die Fähigkeit, zwischen verschiedenen Gruppen innerhalb eines bestimmten Konzepts zu unterscheiden, wodurch der Bias effektiv neutralisiert wird. Der größte Vorteil von WRING besteht darin, dass diese Modifikation nur punktuell wirkt, sodass alle anderen gelernten Verknüpfungen und Beziehungen des Modells intakt bleiben.

Abbildung 1: Top-Ten-Bilder für „teure" Artikel in FashionProductImages und „treue" Hunde in Spawrious vor und nach dem Debiasing per WRING-Entzerrung. Das Beispiel nach der Entzerrung zeigt weniger Farb-Bias bei den Modebildern und eine geringere Verzerrung zugunsten von Corgis bei den Hundebildern. Die Modebilder wurden zu Demonstrationszwecken auf Schwarz-Weiß-Aufnahmen beschränkt. Quelle: MIT

Damit adressiert WRING gezielt das sogenannte Whac-A-Mole-Dilemma, ein weitreichendes Problem bei der Fehlerbehebung von KI-Modellen. Das Whac-A-Mole-Dilemma beschreibt das Phänomen, dass die erfolgreiche Reduzierung eines bestimmten Bias oder Shortcuts unbeabsichtigt dazu führt, dass das Modell sich auf andere, noch vorhandene Verzerrungen stürzt oder diese sogar verstärkt. Ein anschauliches Beispiel aus der Medizin: Entfernt man aus einem KI-Modell, das Bilder von klinischem Personal auswertet, einen rassistischen Bias, kann das den unvorhergesehenen Effekt haben, dass stattdessen ein geschlechtsspezifischer Bias deutlich verstärkt wird.

Traditionelle Methoden wie das Projection Debiasing sind sehr anfällig für dieses Dilemma. Bei diesem Ansatz wird der Bereich mit der unerwünschten Information aus dem Repräsentationsraum des Modells entfernt. Das Problem dabei ist, dass durch dieses Vorgehen unbeabsichtigt auch andere gelernte Beziehungen im Modell verschoben oder gequetscht werden. WRING verhindert diesen Effekt: Durch die bloße Rotation der Parameter lässt sich zeigen, dass ein Ziel-Bias signifikant reduziert werden kann, ohne dabei Verzerrungen in anderen Bereichen zu vergrößern.

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Weitere Artikel

Trump zwingt KI-Firmen in die Knie – Anthropic kämpft, OpenAI kuscht!

️ Über diese Episode In dieser brisanten Episode diskutieren Christian und Yusuf über den ethischen Showdown zwischen Anthropic

Nutzer strafen ChatGPT ab: Deinstallationen nach Militär-Deal steigen um fast 300 Prozent

Die Zahl der Deinstallationen der ChatGPT App in den USA stieg am Samstag um 295 % im Vergleich zum Vortag.

Militärischer KI-Einsatz: Anthropic und US-Regierung im offenen Schlagabtausch

Der Konflikt zwischen Anthropic und der US-Regierung über den militärischen Einsatz der KI-Technologie des Unternehmens ist in den vergangenen Tagen

Zum Inhalt springen

Zum Inhalt springen