Google investiert bis zu 40 Milliarden US-Dollar in Anthropic. Damit ist eine neue Runde in der Auseinandersetzung zwischen den beiden weltweit führenden KI-Schmieden Anthropic und OpenAI eingeläutet. Wer hier am Ende vorn liegt, entscheidet sich auf zwei Ebenen: der physischen Infrastruktur und der Frage, wer die zahlungskräftigen Geschäftskunden für sich gewinnt.

Wie Google bei Anthropic einsteigt

Die jüngste Google Investition in Anthropic ist in zwei Tranchen aufgeteilt, die an die Skalierung des Unternehmens gekoppelt sind. Sofort fließen 10 Milliarden US-Dollar als Barinvestition. Das entspricht einer Bewertung von Anthropic in Höhe von 350 Milliarden US-Dollar und damit exakt der Bewertung, die das Startup bereits in der Februar-Finanzierungsrunde 2026 erzielt hatte. Die zweite, deutlich größere Tranche umfasst weitere 30 Milliarden US-Dollar, allerdings nur, wenn Anthropic vorher festgelegte technologische und kommerzielle Meilensteine erreicht.

Spannend wird die Sache, wenn man genauer hinschaut, wohin das Geld am Ende fließt. Anthropic ist heute schon einer der größten Kunden von Google Cloud, und ein erheblicher Teil der 40 Milliarden wird genutzt, um eine deutliche Expansion der Rechenkapazitäten innerhalb genau dieser Cloud zu finanzieren. Anders gesagt: Google gibt Anthropic Geld, damit Anthropic bei Google Server, Speicher und Rechenzeit anmietet. Die Investition fließt also als Cloud-Umsatz an den Investor zurück. Dieses Modell, das in der Branche als Kreislauffinanzierung oder zirkuläre Investitionen bezeichnet wird, lässt die Hyperscaler ihre Auslastung zuverlässig planen.

Mindestens genauso wichtig wie die Investitionssumme ist die zugesagte Energiekapazität. Google Cloud hat sich verpflichtet, Anthropic über die kommenden fünf Jahre dedizierte 5 Gigawatt Rechenkapazität bereitzustellen. Zur Einordnung: 5 Gigawatt entsprechen ungefähr dem grundlastfähigen Strombedarf mehrerer Großstädte oder der Leistung von fünf durchschnittlichen Kernkraftwerken. Diese Kapazitäten werden schrittweise aufgebaut und sollen 2027 vollständig online gehen.

Eng verknüpft mit der Energiezusage ist die Hardware-Strategie. Anthropic, Google und der Halbleiterspezialist Broadcom haben ihre bestehende Zusammenarbeit massiv vertieft und arbeiten gemeinsam an mehreren Gigawatt an Tensor Processing Units (TPUs) der nächsten Generation. Diese hochspezialisierten Chips sollen Googles Antwort auf die Vera-Rubin-Architektur von NVIDIA darstellen. Indem Anthropic massiv auf maßgeschneiderte TPUs setzt, reduziert das Unternehmen seine Abhängigkeit von klassischen Grafikprozessoren und positioniert sich an der Spitze hardwareoptimierter KI-Ausführung.

Multi-Cloud als Lebensversicherung: der Amazon-Deal

Googles Engagement bei Anthropic muss man im Zusammenhang mit einem zweiten Deal sehen. Kurz vor Googles Ankündigung hatte Amazon Web Services sein Engagement bei Anthropic ebenfalls drastisch ausgeweitet. Zu den bereits investierten 8 Milliarden US-Dollar kamen weitere 25 Milliarden hinzu: 5 Milliarden sofort, 20 Milliarden gebunden an bestimmte Meilensteine. Bei dieser Runde war Anthropic mit 380 Milliarden US-Dollar sogar leicht höher bewertet als beim Google-Deal.

Der entscheidende Punkt ist die Gegenleistung von Anthropic: Das KI-Unternehmen verpflichtete sich vertraglich, im kommenden Jahrzehnt über 100 Milliarden US-Dollar für AWS-Technologien auszugeben. Auch hier sicherte sich Anthropic weitere 5 Gigawatt Energiekapazität, die primär auf Amazons hauseigenen KI-Chips Trainium2 bis Trainium4 laufen sollen. Schon heute nutzt Anthropic mehr als eine Million Trainium2-Chips, um seine Claude-Modelle zu trainieren und auszuliefern.

Während OpenAI fast ausschließlich auf NVIDIA-Hardware setzt, hat Anthropic seine technische Architektur so gebaut, dass die Workloads dynamisch zwischen Trainium-Chips bei AWS, TPUs bei Google und klassischen NVIDIA-GPUs verschoben werden können. Sollten die Preise für NVIDIA-GPUs wegen geopolitischer Verwerfungen oder Lieferengpässen explodieren, kann Anthropic Training und Inferenz seiner Modelle einfach umlagern. Diese Multi-Cloud-Strategie erlaubt nicht nur bessere Verhandlungspositionen, sondern garantiert Geschäftskunden auch jene Verlässlichkeit und strenge Service Level Agreements, auf die sie angewiesen sind.

Hinzu kommt ein gigantischer Vertriebsvorteil. Über die native Integration in AWS Bedrock und Google Vertex AI können mehr als 100.000 bestehende Enterprise-Kunden direkt auf Claude zugreifen, ohne neue Verträge oder Beschaffungsprozesse durchlaufen zu müssen.

Infrastruktur-Partner Gesamte Investitionszusagen (potenziell) Zugesicherte Energiekapazität Primäre Hardware-Architektur Dauerhafte Gegenleistung (Cloud Spend Commitment) Amazon Web Services (AWS) Bis zu 33 Milliarden USD (inkl. Alt-Invests) 5 Gigawatt AWS Trainium2-4, Graviton CPUs 100 Milliarden USD über 10 Jahre Google Cloud Bis zu 40 illiarden USD 5 Gigawatt (Start 2027) Google TPU v6/v8, Broadcom ASICs Massive Expansion und Auslastung der Google Cloud

Tabelle 1: Investments von AWS und Google in Anthropic

OpenAIs Antwort: Stargate, NVIDIA und 500 Milliarden Dollar

Während Anthropic auf Diversifizierung setzt, fährt OpenAI gemeinsam mit Microsoft eine völlig andere Strategie: ultimative Skalierung mit radikaler Hardware-Konzentration. Im Januar 2025 wurde gemeinsam mit US-Präsident Donald Trump das Stargate-Projekt verkündet: ein Joint Venture aus OpenAI, der japanischen SoftBank Group, Oracle und dem emiratischen Investmentvehikel MGX.

500 Milliarden US-Dollar sollen bis 2029 in den Aufbau hyper-skalierter KI-Infrastruktur fließen, primär in den USA. Der Flaggschiff-Standort liegt in Abilene, Texas. Das Konsortium operiert allerdings längst global. Über die Initiative „OpenAI for Countries" entstanden Stargate-Knotenpunkte in den Vereinigten Arabischen Emiraten, Norwegen und Großbritannien, sogar in Lateinamerika ist eine Anlage mit bis zu 500 Megawatt Kapazität geplant. Insgesamt strebt OpenAI ein Netz von Rechenzentren mit einer Gesamtkapazität von 10 Gigawatt an: genug Strom, um rund 7,5 Millionen moderne Haushalte zu versorgen.

Im Zentrum von OpenAIs technologischer Umsetzung steht NVIDIA. Beide Unternehmen unterzeichneten eine strategische Absichtserklärung über mindestens 10 Gigawatt an NVIDIA-basierten KI-Rechenzentren. NVIDIA wiederum hat sich bereit erklärt, sukzessive bis zu 100 Milliarden US-Dollar in OpenAI zu investieren, strikt gekoppelt an die tatsächliche Inbetriebnahme der Rechenleistung. Die erste Phase der Skalierung baut auf der neuen „Vera Rubin"-Plattform NVL72 auf, deren wassergekühlte Monolithen extreme Leistungsdichten erfordern und im zweiten Halbjahr 2026 ans Netz gehen sollen.

Um all das zu finanzieren, hat OpenAI im Frühjahr 2026 eine sehr große Finanzierungsrunde abgeschlossen: 122 Milliarden US-Dollar an gebundenem Kapital bei einer Post-Money-Bewertung von 852 Milliarden US-Dollar. Mit dabei waren neben Microsoft auch Amazon, NVIDIA, SoftBank, a16z, BlackRock und Fidelity. Erstmals wurde das Modell sogar für den breiten Kapitalmarkt geöffnet: Über 3 Milliarden US-Dollar kamen von Privatinvestoren über Bankkanäle. ARK Invest kündigte die Aufnahme in verschiedene ETFs an.

Das Risiko der Kreislauffinanzierung

Bei Investitionssummen dieser Größenordnung mehren sich kritische Stimmen. Im Zentrum der Kritik steht das bereits erwähnte Geschäftsmodell der Kreislauffinanzierung. Ein Hyperscaler investiert Milliarden in ein KI-Startup, oft bei aus traditioneller Sicht irrationalen Bewertungen. Als Gegenleistung verpflichtet sich das Startup, die Investitionssumme oder ein Vielfaches davon über Cloud-Dienstleistungen zurückfließen zu lassen. Strategisch ist das nachvollziehbar, weil es Marktanteile zementiert. Bilanziell birgt es jedoch Risiken, weil die Umsätze der Cloud-Provider faktisch durch deren eigene Investitionen gestützt werden. Sollte der frische externe Kapitalfluss von Venture-Capital-Firmen, Staatsfonds und Privatinvestoren stocken, bevor die KI-Startups eigenständig profitabel werden, könnte dieser Kreislauf abrupt zusammenbrechen. OpenAI mit projizierten Verlusten von 14 Milliarden US-Dollar im Jahr 2026 ist hier besonders exponiert.

Trotzdem widersprechen prominente Finanzhäuser wie Morgan Stanley, Goldman Sachs und UBP der These der KI-Blase. Sie sehen den Markt vielmehr in einer Phase des industriellen Aufbaus, vergleichbar mit dem Ausbau des Eisenbahnnetzes oder des Breitband-Internets. Bis 2028 sollen fast 3 Billionen US-Dollar an KI-bezogenen Infrastrukturinvestitionen in die Weltwirtschaft fließen.

Das Überholmanöver: Anthropic zieht beim Umsatz vorbei

Im April 2026 überschritt die annualisierte Umsatzrate von Anthropic erstmals 30 Milliarden US-Dollar. Das ist eine Verdreifachung gegenüber den rund 9 Milliarden zum Jahresende 2025. Anthropic gilt damit als das am schnellsten wachsende Technologieunternehmen aller Zeiten und legte in den vergangenen drei Jahren jährlich um mehr als den Faktor 10 zu. Auf Sekundärmärkten wurde das Startup zeitweise mit einer Billion US-Dollar bewertet und übertraf damit kurzzeitig sogar OpenAI.

OpenAI selbst kommt im gleichen Zeitraum auf eine annualisierte Run-Rate von rund 24 Milliarden US-Dollar. Auch das ist beachtlich, doch das aggressive Wachstum von Anthropic hat den lange Zeit dominanten Konkurrenten erstmals vom Umsatzthron gestoßen. Eine Analyses des Forschungsinstituts Epoch AI bestätigt das.

Der Grund für diesen Erfolg liegt in einer konsequenten Ausrichtung auf lukrative Geschäftskunden. Rund 80 Prozent des Umsatzes von Anthropic kommen aus dem B2B-Bereich. Die Zahl der Unternehmenskunden, die mehr als eine Million US-Dollar pro Jahr für Anthropic-Dienste ausgeben, verdoppelte sich in den ersten Monaten des Jahres auf über 1.000. Acht der zehn größten Fortune-10-Unternehmen nutzen die Claude-Modelle. Im umkämpften Markt für Enterprise-LLM-APIs hält Anthropic einen Marktanteil von 32 Prozent, OpenAI kommt auf 25 Prozent (Stand Mitte 2025).

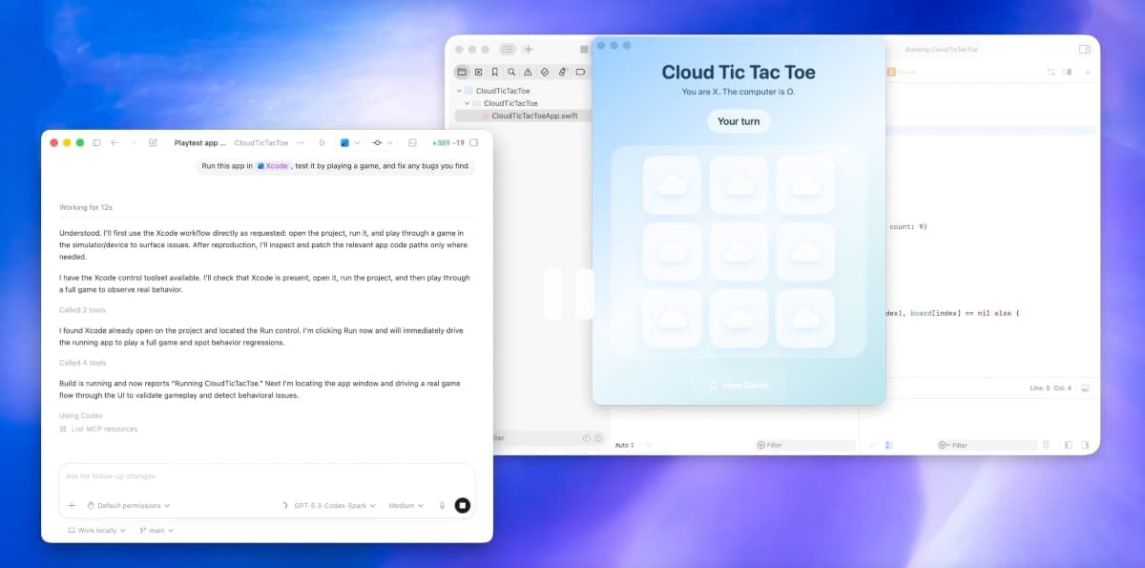

Besonders eindrucksvoll ist die Dominanz von Anthropic im Bereich Softwareentwicklung. Claude Code erreichte Marktanteil von 54 Prozent bei KI-Programmierwerkzeugen und erzielt eine eigene Run-Rate von über 2,5 Milliarden US-Dollar. Damit liegt Claude Code weit vor Konkurrenten wie GitHub Copilot. Rund 4 Prozent aller öffentlichen GitHub-Commits weltweit gehen mittlerweile auf Claude Code zurück. Diese Verankerung in den Entwicklungsumgebungen schafft einen enormen Lock-in-Effekt. Selbst Microsoft, obwohl Großaktionär bei OpenAI, hat Claude unlängst in die eigene Copilot-Suite integriert, um der Kundennachfrage gerecht zu werden.

OpenAI kämpft dagegen mit dem eigenen Erfolg im Konsumentenmarkt. ChatGPT verzeichnet 900 Millionen wöchentlich aktive Nutzer und wird wohl bald die Milliardenmarke knacken. Trotz 50 Millionen Premium-Abonnenten zahlen rund 95 Prozent der Nutzer nichts für den Dienst. Die kostenlose Massennutzung verschlingt Rechenressourcen, die andernfalls für lukrative B2B-Aufträge verfügbar wären. Um das Defizit auszugleichen, drängt OpenAI nun massiv ins Werbegeschäft mit dem Ziel, bis 2030 einen Werbeumsatz von 100 Milliarden US-Dollar zu erreichen. Ein riskanter Strategiewechsel, der Geschäftskunden und Premium-Nutzer verprellen könnte. Mit operativer Profitabilität rechnet OpenAI frühestens 2030, während Anthropic bereits für 2028 oder 2029 schwarze Zahlen prognostiziert.

Wer am Ende gewinnt

OpenAI und Anthropic nähern sich einander an: Ihre Basismodelle ähneln sich in der Leistungsfähigkeit bei Standardaufgaben stark. Ein möglicher Sieg wird auf zwei anderen Ebenen entschieden: der physischen Infrastruktur-Resilienz und der Tiefe der Integration bei Endkunden.

Aktuell sprechen die Indikatoren für Anthropic. Die Multi-Cloud-Strategie zahlt sich aus, der B2B-Markt ist nach erfolgreicher Integration ausdauernd, und der Weg zur Profitabilität ist klar vorgezeichnet. Sollte die Industrie in den nächsten drei Jahren nicht in der Lage sein, eine echte allgemeine KI zu erzwingen, dürfte Anthropic diesen Wettkampf gewinnen. OpenAI darf man trotzdem nicht abschreiben: Die schiere Wucht des 500-Milliarden-Stargate-Projekts ist historisch ohne Beispiel, und sollte das Unternehmen als erstes eine echte AGI erreichen, wären sämtliche Marktanteilsverluste augenblicklich obsolet.

Die wichtigste Erkenntnis betrifft allerdings eine dritte Gruppe von Akteuren: die Hyperscaler selbst. Unabhängig von der Frage, ob Geschäftskunden künftig Modelle von OpenAI oder Anthropic bevorzugen: die Rechenoberfläche läuft unweigerlich über AWS, Google Cloud oder Azure. Selbst wenn Anthropic den Modellkrieg gewinnen sollte, fließen die Milliarden durch das vertragliche Commitment in Amazons Bilanzen zurück. Genau das Gleiche gilt für Googles 40-Milliarden-Investment, das die Auslastung der TPU-Cluster für das nächste Jahrzehnt sichert.

Die Hyperscaler haben durch diese Konstruktionen die faktische Unabhängigkeit der KI-Startups beendet und eine vollständige vertikale Integration vom Custom-Chip über das Rechenzentrum bis zur Anwendung für den Endkunden geschaffen. Der KI-Markt ist zu einem Oligopol globaler Infrastrukturbetreiber geworden, welches das Schicksal der Innovation im kommenden Jahrzehnt mitbestimmen wird.

Ihr Wartungsspezialist für alle großen Hardware Hersteller

Durch Jahrzehnte lange Erfahrung wissen wir worauf es bei der Wartung Ihrer Data Center Hardware ankommt. Profitieren Sie nicht nur von unserer Erfahrung, sondern auch von unseren ausgezeichneten Preisen. Holen Sie sich ein unverbindliches Angebot und vergleichen Sie selbst.

Weitere Artikel

OpenAI erweitert Codex: automer Entwickler, der im Hintergrund arbeiten kann

OpenAI hat ein umfangreiches Update für Codex veröffentlicht. Die Erweiterungen zielen darauf ab, Codex tiefer in den gesamten Software-Entwicklungsprozess zu

Claude Opus 4.7 ist da: das bisher leistungsfähigste Modell von Anthropic?

Heute wurde Claude Opus 4.7 veröffentlicht und ist ab sofort allgemein verfügbar. Es bietet insbesondere bei komplexen, langwierigen Aufgaben

Claude Mythos hackt Netzwerke mit 30% Erfolgsquote – Plus: OpenAI-Leak & das Ende der Hierarchie

️ Über diese Episode Eine außergewöhnliche Solo-Folge mit Yusuf, der diesmal ohne Christian tief in die wichtigsten KI-Entwicklungen

Zum Inhalt springen

Zum Inhalt springen